エコー・チェンバー

Echo chamber (media studies), 反響室

★ニュースメディアの議論において、エコーチェンバーとは、閉じたシステ

ム(SNSのフォロアーの集団)の中でコミュニケーションと反復によって信念が増幅または強化され、反論から隔離された状況を指す。エコーチェンバーに参

加することによって、人

々は反対意見に出会うことなく既存の見解を強化する情報を探し出すことができ、意図しない確認バイアスが生じる可能性がある。ソーシャルメディアでは、エ

コーチェンバーは多様な視点に触れることを制限し、前提となる物語やイデオロギーを支持・強化すると考えられている。

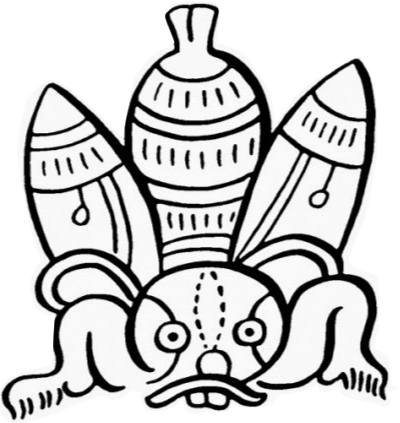

【種まき Seeding】Actors feed intentional and strategic deceptions onto social media, hiding sources and intent.アクター[活動家]たちは意図的かつ戦略的な欺瞞をソーシャルメディアに流す。情報源と意図を隠しながら。

【反響化 Echoing】Disseminates disinformation

through preexisting controversies. Stokes adversarial narratives

against rhetorically constructed opponents.

既存の論争を通じて偽情報を拡散する。修辞的に構築された敵対者に対する敵対的な物語を煽る。

| In discussions of

news media, an echo chamber refers to situations in which beliefs are

amplified or reinforced by communication and repetition inside a closed

system and insulated from rebuttal.[1] By participating in an echo

chamber, people are able to seek out information that reinforces their

existing views without encountering opposing views, potentially

resulting in an unintended exercise in confirmation bias. Echo chambers

may increase social and political polarization and extremism.[2] On

social media, it is thought that echo chambers limit exposure to

diverse perspectives, and favour and reinforce presupposed narratives

and ideologies.[3][4] The term is a metaphor based on an acoustic echo chamber, in which sounds reverberate in a hollow enclosure. Another emerging term for this echoing and homogenizing effect within social media communities on the Internet is cultural tribalism.[5] Many scholars note the effects that echo chambers can have on citizens' stances and viewpoints, and specifically implications has for politics.[6] However, some studies have suggested that the effects of echo chambers are weaker than often assumed.[7] |

ニュースメディアの議論において、エコーチェンバーとは、閉じたシステ

ムの中でコミュニケーションと反復によって信念が増幅または強化され、反論から隔離された状況を指す[1]。エコーチェンバーに参加することによって、人

々は反対意見に出会うことなく既存の見解を強化する情報を探し出すことができ、意図しない確認バイアスが生じる可能性がある。ソーシャルメディアでは、エ

コーチェンバーは多様な視点に触れることを制限し、前提となる物語やイデオロギーを支持・強化すると考えられている[3][4]。 この用語は、中空の囲いの中で音が反響する音響反響室に基づいたメタファーである。インターネット上のソーシャルメディアコミュニティにおけるこの反響と 均質化の効果に対する別の新たな用語は、文化的部族主義である[5]。 多くの学者はエコーチェンバーが市民のスタンスや視点に与える影響、特に政治への影響を指摘している[6]。 しかし、いくつかの研究はエコーチェンバーの効果がしばしば仮定されるよりも弱いことを示唆している[7]。 |

| Concept The Internet has expanded the variety and amount of accessible political information. On the positive side, this may create a more pluralistic form of public debate; on the negative side, greater access to information may lead to selective exposure to ideologically supportive channels.[2] In an extreme "echo chamber", one purveyor of information will make a claim, which many like-minded people then repeat, overhear, and repeat again (often in an exaggerated or otherwise distorted form)[8] until most people assume that some extreme variation of the story is true.[9] The echo chamber effect occurs online when a harmonious group of people amalgamate and develop tunnel vision. Participants in online discussions may find their opinions constantly echoed back to them, which reinforces their individual belief systems due to the declining exposure to other's opinions.[10] Their individual belief systems are what culminate into a confirmation bias regarding a variety of subjects. When an individual wants something to be true, they often will only gather the information that supports their existing beliefs and disregard any statements they find that are contradictory or speak negatively upon their beliefs.[11] Individuals who participate in echo chambers often do so because they feel more confident that their opinions will be more readily accepted by others in the echo chamber.[12] This happens because the Internet has provided access to a wide range of readily available information. People are receiving their news online more rapidly through less traditional sources, such as Facebook, Google, and Twitter. These and many other social platforms and online media outlets have established personalized algorithms intended to cater specific information to individuals’ online feeds. This method of curating content has replaced the function of the traditional news editor.[13] The mediated spread of information through online networks causes a risk of an algorithmic filter bubble, leading to concern regarding how the effects of echo chambers on the internet promote the division of online interaction.[14] It is important to note that members of an echo chamber are not fully responsible for their convictions. Once part of an echo chamber, an individual might adhere to seemingly acceptable epistemic practices and still be further misled. Many individuals may be stuck in echo chambers due to factors existing outside of their control, such as being raised in one.[15] Furthermore, the function of an echo chamber does not entail eroding a member's interest in truth; it focuses upon manipulating their credibility levels so that fundamentally different establishments and institutions will be considered proper sources of authority.[16] |

コンセプト インターネットは、アクセス可能な政治情報の種類と量を拡大した。ポジティブな面では、これはより多元的な形の公開討論を生み出すかもしれない。ネガティ ブな面では、情報へのアクセスが増えることで、イデオロギー的に支持するチャンネルに選択的に触れることになるかもしれない[2] 極端な「反響室」では、ある情報の提供者がある主張をすると、多くの同じ考えの人々が繰り返し、耳にし、また繰り返し(しばしば誇張または他の形で歪め て)、ほとんどの人々がその物語のある極端なバリエーションを真実だと仮定するまで続く[8][9]。 エコーチェンバー(反響室)効果は、オンライン上で調和のとれた人々のグループが合体し、トンネル・ビジョンを開発するときに発生する。オンライン上の議 論の参加者は、自分の意見が常に反響していることに気づき、他の人の意見に触れる機会が減ることで個人の信念体系が強化される[10]。エコーチェンバー に参加する人は、自分の意見がエコーチェンバー内の他の人に受け入れられやすいと確信するために参加することが多い[11]。人々は、フェイスブック、 グーグル、ツイッターといった従来とは異なる情報源を通じて、より迅速にオンラインでニュースを受け取っている。これらのソーシャル・プラットフォームや オンライン・メディアは、個人のオンライン・フィードに特定の情報を提供することを目的としたパーソナライズされたアルゴリズムを確立している。このよう にコンテンツをキュレーションする方法は、従来のニュース編集者の機能を代替している[13]。オンラインネットワークを介した情報の媒介は、アルゴリズ ムによるフィルターバブルのリスクを引き起こし、インターネット上のエコーチェンバーの効果がオンライン交流の分裂を促進することについての懸念につな がっている[14]。 エコーチェンバーのメンバーは、自分の信念に完全な責任を持たないことに注意することが重要である。エコーチェンバーの一員になると、一見許容されるよう な認識論的実践に固執し、それでもさらに惑わされるかもしれない。多くの人は、エコーチェンバーで育てられるなど、自分ではコントロールできない要因に よって、エコーチェンバーから抜け出せないでいるのかもしれない[15]。 さらにエコーチェンバーの機能はメンバーの真実への関心を損なうことではなく、根本的に異なる確立や制度が適切な権威の源と見なされるように彼らの信頼性 のレベルを操作することに焦点を合わせている[16]。 |

| Empirical research However, empirical findings to clearly support these concerns are needed [17] and the field is very fragmented when it comes to empirical results. There are some studies that do measure echo chamber effects, such as the study of Bakshy et al. (2015).[18][19] In this study the researchers found that people tend to share news articles they align with. Similarly, they discovered a homophily in online friendships, meaning people are more likely to be connected on social media if they have the same political ideology. In combination, this can lead to echo chamber effects. Bakshy et al. found that a person's potential exposure to cross-cutting content (content that is opposite to their own political beliefs) through their own network is only 24% for liberals and 35% for conservatives. Another set of studies suggests that echo chambers exist, but that these not a widespread phenomenon: Based on survey data, Dubois and Blank (2018) show that most people do consume news from various sources, while around 8% consume media with low diversity.[21] Similarly, Rusche (2022) shows that, most Twitter users do not show behavior that resembles that of an echo chamber. However, through high levels of online activity, the small group of users that do, make up a substantial share populist politicians' followers, thus creating homogeneous online spaces.[22] Finally, there are other studies which contradict the existence of echo chambers. Some found that people also share news reports that don't align with their political beliefs.[23] Others found that people using social media are being exposed to more diverse sources than people not using social media.[24] In summation, it remains that clear and distinct findings are absent which either confirm or falsify the concerns of echo chamber effects. Research on the social dynamics of echo chambers shows that the fragmented nature of online culture, the importance of collective identity construction, and the argumentative nature of online controversies can generate echo chambers where participants encounter self-reinforcing beliefs.[20] Researchers show that echo chambers are prime vehicles to disseminate disinformation, as participants exploit contradictions against perceived opponents amidst identity-driven controversies.[20] |

経験的研究 しかし、これらの懸念を明確にサポートする実証的な結果が必要であり[17]、実証的な結果に関して言えば、この分野は非常に断片的である。Bakshy らの研究(2015)のようにエコーチェンバー効果を測定している研究もrう[18][19]。この研究で研究者は、人々は自分が賛同するニュース記事を 共有する傾向があることを見つけた。同様に、彼らはオンライン上の友人関係における同類性を発見した。つまり、同じ政治的イデオロギーを持っている場合、 人々はソーシャルメディア上でよりつながりやすいのだ。このような組み合わせは、エコーチェンバー(反響室)効果につながる可能性がある。Bakshyら は、人が自分のネットワークを通じて横断的コンテンツ(自分の政治的信条と正反対のコンテンツ)に触れる可能性は、リベラル派で24%、保守派で35%に 過ぎないことを発見している。 別の一連の研究は、エコーチェンバーが存在することを示唆しているが、これらは広範な現象ではないことを示唆している。調査データに基づき、Dubois and Blank (2018)は、ほとんどの人が様々なソースからニュースを消費している一方で、約8%が多様性の低いメディアを消費していることを示している[21] 同様に、Rusche (2022) は、ほとんどのツイッターユーザーがエコーチャンバーのそれに類似する行動を示していないことを示している。しかし、高いレベルのオンライン活動を通じ て、そうする少数のユーザー集団がポピュリスト政治家のフォロワーのかなりのシェアを占め、その結果、均質なオンライン空間を作り出している[22]。 最後に、エコーチェンバーの存在と矛盾する研究もある。あるものは、人々は自分の政治的信条に沿わないニュースレポートも共有することを見つけた [23]。また、ソーシャルメディアを使われる人々は、ソーシャルメディアを使わない人々よりも多様なソースにさらされていることを見つけた[24]。ま とめると、エコーチェンバー効果の懸念を確認または偽証する明確で明確な知見は存在しないことになる。 エコーチェンバーの社会的ダイナミクスに関する研究は、オンライン文化の断片化された性質、集団的アイデンティティ構築の重要性、オンライン論争の議論的 性質が、参加者が自己強化的信念に遭遇するエコーチェンバーを生成することを示している。研究者は、アイデンティティ主導の論争の中で、参加者が認識され た反対者に対する矛盾を利用するので、エコーチェンバーがディスインフォメーションの普及に最適な手段であると述べている[20]。 |

| Difficulties of researching

processes There are several reasons why empirical findings are so fragmented and unclear, making it difficult to achieve consistent and comparable results. There is a lack of conceptual clarity due to different definitions and the novelty of these phenomena. Measurement methods and usages of concepts are inconsistent. The data used in empirical research isn't representative of the entire population because the effects are measured in either an individual or a specific group; Facebook users in the US, for example, are more likely to be feminine and have a higher educational status than the average US population. Social media platforms continually change their algorithmic filtering without making these algorithms public. Finally, most studies are done in the US, which has a two-party system, and their results cannot be applied to political systems with more political parties.[25] |

研究過程の困難さ 実証的な知見が断片的で不明瞭であり、一貫性のある比較可能な結果を得ることが困難である理由はいくつかある。定義が異なることや、これらの現象が新規性 の高いものであるため、概念が明確でない。測定方法や概念の用法に一貫性がない。実証研究に使われるデータは、個人または特定のグループにおいて効果が測 定されるため、全人口を代表するものではない。例えば、米国のFacebookユーザーは、米国の平均的な人口よりも女性であり、高い教育水準にある傾向 がある。ソーシャルメディア・プラットフォームは、アルゴリズムを公開することなく、継続的にフィルタリングを変更している。最後に、ほとんどの研究は二 大政党制の米国で行われ、その結果はより多くの政党が存在する政治体制に適用することはできない[25]。 |

| Echo chambers vs epistemic

bubbles In recent years, closed epistemic networks have increasingly been held responsible for the era of post-truth and fake news.[26] However, the media frequently conflates two distinct concepts of social epistemology: echo chambers and epistemic bubbles.[16] An epistemic bubble is an informational network in which important sources have been excluded by omission, perhaps unintentionally. It is an impaired epistemic framework which lacks strong connectivity.[27] Members within epistemic bubbles are unaware of significant information and reasoning. On the other hand, an echo chamber is an epistemic construct in which voices are actively excluded and discredited. It does not suffer from a lack in connectivity; rather it depends on a manipulation of trust by methodically discrediting all outside sources.[28] According to research conducted by the University of Pennsylvania, members of echo chambers become dependent on the sources within the chamber and highly resistant to any external sources.[29] An important distinction exists in the strength of the respective epistemic structures. Epistemic bubbles are not particularly robust. Relevant information has merely been left out, not discredited.[30] One can ‘pop’ an epistemic bubble by exposing a member to the information and sources that they have been missing.[15] Echo chambers, however, are incredibly strong. By creating pre-emptive distrust between members and non-members, insiders will be insulated from the validity of counter-evidence and will continue to reinforce the chamber in the form of a closed loop.[28] Outside voices are heard, but dismissed. As such, the two concepts are fundamentally distinct and cannot be utilized interchangeably. However, one must note that this distinction is conceptual in nature, and an epistemic community can exercise multiple methods of exclusion to varying extents. |

エコーチェンバー〈対〉認識的バブル 近年、閉じた認識ネットワークは、ポスト真実やフェイクニュースの時代に責任があるとされることが多くなっている[26]。しかし、メディアは、社会認識 論の二つの異なる概念であるエコーチェンバーと認識バブルをしばしば混同している[16]。 認識バブルは、重要なソースがおそらく意図せず省略されることによって除外されている情報ネットワークである。それは強い結合性を欠く損なわれた認識力の 枠組みである[27]。認識力の泡の中のメンバーは、重要な情報と推論に気づかない。 一方、エコーチェンバーとは、声が積極的に排除され、信用されなくなるような認識論的な構成である。ペンシルバニア大学の研究によれば、エコーチェンバー のメンバーはその内部の情報源に依存し、外部の情報源に対して非常に抵抗感を持つようになる[28]。 重要な違いは、それぞれの認識構造の強さである。エピステミックバブルは特に強固なものではない。関連する情報が省かれただけで、信用を失ったわけではな い[30]。人は、メンバーが見逃していた情報や情報源に触れることで、認識力のバブルを「弾く」ことができる[15]。 しかし、エコーチェンバーは信じられないほど強力である。メンバーと非メンバーの間に先制的な不信感を生み出すことで、インサイダーは反証の有効性から遮 断され、閉じたループという形でエコーチェンバーを強化し続ける。 28] 外部の声は聞こえるが、棄却される。 このように、この二つの概念は基本的に異なるものであり、互換的に利用することはできない。しかし、この区別は概念的なものであり、認識論的共同体は、程 度の差こそあれ、複数の排除の方法を行使できることに注意しなければならない。 |

| A

filter bubble – a term coined by internet activist Eli Pariser – is a

state of intellectual isolation that allegedly can result from

personalized searches when a website algorithm selectively guesses what

information a user would like to see based on information about the

user, such as location, past click-behavior and search history. As a

result, users become separated from information that disagrees with

their viewpoints, effectively isolating them in their own cultural or

ideological bubbles. The choices made by these algorithms are not

transparent. |

フィル

ターバブルとは、インターネット活動家のイーライ・パリサーによる造語で、ウェブサイト・アルゴリズムが、位置情報、過去のクリック行動、検索履歴などの

ユーザーに関する情報に基づいて、ユーザーが見たい情報を選択的に推測し、パーソナライズ検索によって生じるとされる知的孤立状態のことである。その結

果、ユーザーは自分の見解と異なる情報から切り離され、独自の文化的・思想的バブルの中に事実上隔離されることになります。このようなアルゴリズムによる

選択は、透明性がありません。 |

| Homophily

is the tendency of individuals to associate and bond with similar

others, as in the proverb "birds of a feather flock together". The

presence of homophily has been detected in a vast array of network

studies. For example, a study conducted by Bakshy et. al. explored the

data of 10.1 million Facebook users. These users identified as either

politically liberal, moderate, or conservative, and the vast majority

of their friends were found to have a political orientation that was

similar to their own. Facebook algorithms recognize this and selects

information with a bias towards this political orientation to showcase

in their newsfeed.[31] |

ホ

モフィリーとは、個人が類似した他者と結びつき、絆を深める傾向を指し、ことわざの「類は友を呼ぶ」に例えられる。ホモフィリーの存在は、数多くのネット

ワーク研究で確認されている。例えば、Bakshyらによる研究では、1,010万人のFacebookユーザーのデータを分析した。これらのユーザー

は、政治的にリベラル、中道、保守のいずれかに分類され、その大多数の友人は、自分と似た政治的傾向を持つことが判明した。Facebookのアルゴリズ

ムはこの傾向を認識し、ニュースフィードに表示する情報を、この政治的傾向に偏ったものを選択している。[31] |

| Recommender

systems are information filtering systems put in place on different

platforms that provide recommendations depending on information

gathered from the user. In general, recommendations are provided in

three different ways: based on content that was previously selected by

the user, content that has similar properties or characteristics to

that which has been previously selected by the user, or a combination

of both.[31] Both echo chambers and filter bubbles relate to the ways individuals are exposed to content devoid of clashing opinions, and colloquially might be used interchangeably. However, echo chamber refers to the overall phenomenon by which individuals are exposed only to information from like-minded individuals, while filter bubbles are a result of algorithms that choose content based on previous online behavior, as with search histories or online shopping activity.[18] Indeed, specific combinations of homophily and recommender systems have been identified as significant drivers for determining the emergence of echo chambers.[32] |

推薦シ

ステムとは、さまざまなプラットフォームに設置され、ユーザーから収集した情報に応じて推薦を行う情報フィルタリングシステムである。一般に、推薦の方法

は、ユーザーが過去に選択したコンテンツに基づくもの、ユーザーが過去に選択したコンテンツと類似の特性や特徴を持つもの、またはその両方を組み合わせた

ものの3種類である[31]。 エコーチェンバーとフィルターバブルはどちらも、個人が意見の衝突のないコンテンツにさらされる方法に関連しており、口語では同じ意味で使われることがあ る。しかし、エコーチェンバーは、個人が同好の士からの情報のみにさらされる現象全般を指し、フィルターバブルは、検索履歴やオンラインショッピング活動 など、過去のオンライン行動に基づいてコンテンツを選択するアルゴリズムの結果である[18]。 実際、同好と推薦システムの特定の組み合わせが、エコーチェンバー出現の決定に関する重要なドライバーとして識別されてきた[32]。 |

| Online communities Online social communities become fragmented by echo chambers when like-minded people group together and members hear arguments in one specific direction with no counter argument addressed. In certain online platforms, such as Twitter, echo chambers are more likely to be found when the topic is more political in nature compared to topics that are seen as more neutral.[33] Social networking communities are communities that are considered to be some of the most powerful reinforcements of rumors[34] due to the trust in the evidence supplied by their own social group and peers, over the information circulating the news.[35][36] In addition to this, the reduction of fear that users can enjoy through projecting their views on the internet versus face-to-face allows for further engagement in agreement with their peers.[37] This can create significant barriers to critical discourse within an online medium. Social discussion and sharing can potentially suffer when people have a narrow information base and do not reach outside their network. Essentially, the filter bubble can distort one's reality in ways which are not believed to be alterable by outside sources.[38] |

オンライン・コミュニティ オンライン・ソーシャルコミュニティは、同じ考えを持つ人々が集まり、メンバーがある特定の方向への議論を聞き、反論がなされないと、エコーチェンバーに よって分断されてしまう。ツイッターのような特定のオンラインプラットフォームでは、より中立的と見られるトピックと比較して、より政治的な性質のトピッ クの場合にエコーチェンバーが見つかりやすい[33]。ソーシャルネットワークのコミュニティは、ニュースを流れる情報よりも自分のソーシャルグループや 仲間によって供給される証拠への信頼によって、噂の最も強力な補強の1つと見なされるコミュニティである[34]。 [35][36] これに加えて、対面に対してインターネット上で自分の意見を投影することによってユーザーが享受できる恐怖の軽減は、仲間との合意においてさらなる関与を 可能にする[37]。 これはオンラインメディアにおける批判的な議論に大きな障壁を生み出す可能性がある。人々が狭い情報基盤を持ち、自分のネットワークの外に手を伸ばさない とき、社会的な議論と共有は潜在的に苦しむことがある。本質的に、フィルターバブルは外部の情報源によって変更可能であると信じられていない方法で自分の 現実を歪めることができる[38]。 |

| Offline communities Many offline communities are also segregated by political beliefs and cultural views. The echo chamber effect may prevent individuals from noticing changes in language and culture involving groups other than their own. Online echo chambers can sometimes influence an individual's willingness to participate in similar discussions offline. A 2016 study found that "Twitter users who felt their audience on Twitter agreed with their opinion were more willing to speak out on that issue in the workplace".[12] Group polarization can occur as a result of growing echo chambers. The lack of external viewpoints and the presence of a majority of individuals sharing a similar opinion or narrative can lead to a more extreme belief set. Group polarisation can also aid the current of fake news and misinformation through social media platforms.[39] This can extend to offline interactions, with data revealing that offline interactions can be as polarising as online interactions (Twitter), arguably due to social media-enabled debates being highly fragmented.[40] |

オフラインのコミュニティ 多くのオフライン・コミュニティは、政治的信条や文化的見解によって分離されている。反響室効果によって、自分のグループ以外が関与する言語や文化の変化 に気づかないことがあります。オンライン上の反響室は、時に、オフラインで同様の議論に参加する個人の意欲に影響を与えることがあります。2016年の研 究では、「Twitter上のオーディエンスが自分の意見に同意していると感じたTwitterユーザーは、職場でその問題についてより積極的に発言す る」ことがわかりました[12]。 集団の分極化は、エコーチェンバーが発展している結果として起こり得ます。外部の視点がなく、同じような意見や物語を共有する個人の大多数が存在すること で、より極端な信念を持つようになる可能性があります。これはオフラインの交流にも及び、オフラインの交流はオンラインの交流(ツイッター)と同じくらい 分極化する可能性があることをデータが明らかにしており、おそらくソーシャルメディアが可能にする討論が非常に断片的であることが原因です[39]。 |

| Echo chambers have existed in

many forms, such as: The McMartin preschool trial coverage was criticized by David Shaw in his 1990 Pulitzer Prize winning articles, "None of these charges was ultimately proved, but the media largely acted in a pack, as it so often does on big events, and reporters' stories, in print and on the air, fed on one another, creating an echo chamber of horrors."[41] Shaw stated that this case "exposed basic flaws" in news organizations such as "Laziness. Superficiality. Cozy relationships" and "a frantic search to be first with the latest shocking allegation". His mention of "Reporters and editors often abandoned" journalistic principles of "fairness and skepticism" and "frequently plunged into hysteria, sensationalism and what one editor calls 'a lynch mob syndrome'" shows the effect of such an echo chamber and how it alters the coverage of specific types of media. The conservative radio host, Rush Limbaugh, and his radio show was categorized as an echo chamber in the first empirical study concerning echo chambers by researchers Kathleen Hall Jamieson and Frank Capella in their book: Echo Chamber: Rush Limbaugh and the Conservative Media Establishment (2008)[42] The Clinton-Lewinsky scandal reporting was chronicled in Time magazine's 16 February 1998 "Trial by Leaks" cover story[43] "The Press And The Dress: The anatomy of a salacious leak, and how it ricocheted around the walls of the media echo chamber" by Adam Cohen.[44] This case was also reviewed in depth by the Project for Excellence in Journalism in "The Clinton/Lewinsky Story: How Accurate? How Fair?"[45] A New Statesman essay argued that echo chambers were linked to the UK Brexit referendum.[46] The subreddit /r/incels and other online incel communities have also been described as echo chambers.[47][48][49] Discussion concerning opioid drugs and whether or not they should be considered suitable for long-term pain maintenance.[50] The 2016 presidential election was described as an echo chamber, as information was exchanged primarily among individuals with similar political and ideological views. Donald Trump and Hillary Clinton were extremely vocal on Twitter throughout the electoral campaigns, bringing many vocal opinion leaders to the platform. A study conducted by Guo et. al. showed that Twitter communities in support of Trump and Clinton differed significantly, and those that were most vocal were responsible for creating echochambers within these communities.[51] The network of Youtube Channels harbouring and circulating the Flat-Earth Theory has been described as an echo chamber [20] However, since the creation of the internet, scholars have been curious to see the changes in political communication.[52] Due to the new changes in information technology and how it is managed, it is unclear how opposing perspectives can reach common ground in a democracy.[53] The effects seen from the echo chamber effect has largely been cited to occur in politics, such as Twitter[54] and Facebook during the 2016 presidential election in the United States.[19] Some believe that echo chambers played a big part in the success of Donald Trump in the 2016 presidential elections.[55] |

など、エコーチェンバーは様々な形で存在してきた。 マクマーティン保育園の裁判報道は、デヴィッド・ショーによって1990年のピューリッツァー賞受賞記事の中で批判された。「これらの容疑のどれも最終的 には証明されなかったが、メディアは大きな出来事に対してよくするように、ほとんど群れで行動し、記者たちの記事は、印刷物と放送で、互いに影響しあい、 恐怖の反響室を作り出した」[41]。ショーは、この事件は報道機関の「怠惰」、「浅慮」といった基本的欠点が明らかになったと述べている。表面的なこ と。居心地のよい関係」、「最新の衝撃的な疑惑で最初になるための必死の努力」。また、「記者や編集者はしばしば『公正さと懐疑心』というジャーナリズム の原則を放棄し、『しばしばヒステリーやセンセーショナリズム、ある編集者が『リンチ集団症候群』と呼ぶものに陥る』と述べているのは、こうした反響室の 影響とそれが特定のタイプのメディアの報道をどのように変化させるかを示している」と述べている。 保守系ラジオ司会者のラッシュ・リンボーと彼のラジオ番組は、研究者のキャスリーン・ホール・ジェイミソンとフランク・カペラによるエコーチェンバーに関 する最初の実証研究の中でエコーチェンバーに分類されている。エコー・チェンバー。Rush Limbaugh and the Conservative Media Establishment (2008)[42]において、研究者であるキャスリーン・ホール・ジェイミソンとフランク・カペラによるエコーチェンバーに関する最初の実証的研究で、 ラジオ番組がエコーチェンバーに分類されている。 クリントン=ルインスキーのスキャンダル報道は、タイム誌の1998年2月16日の「リークによる裁判」カバーストーリー[43]「The Press And The Dress」で紹介された。アダム・コーエンによる「The anatomy of a salacious leak, and how it ricocheted around the walls of the media echo chamber」[44] この事件は、Project for Excellence in Journalismによる「The Clinton/Lewinsky Story」で詳しくレビューされています。How Accurate? How Fair?」[45]という論文もある。 ニュー・ステーツマンのエッセイは、エコーチェンバーが英国のブレグジット国民投票に関連していると論じた[46]。 サブレディットである/r/incelsや他のオンラインインセルコミュニティもエコーチェンバーとして記述されている[47][48][49]。 オピオイド薬や長期的な痛みの維持に適していると考えるべきかどうかに関する議論[50]2016年の大統領選挙は、主に政治的・思想的に類似した見解を 持つ個人の間で情報が交換されたため、エコー室として記述されていた。ドナルド・トランプとヒラリー・クリントンは選挙戦を通じてTwitterで極めて 発言力が強く、多くの声高なオピニオンリーダーをこのプラットフォームに引き込んだ。Guoらによって行われた研究では、トランプとクリントンを支持する ツイッターコミュニティは大きく異なり、最も声高に主張する人たちはこれらのコミュニティ内でエコーチェンバーを作り出す役割を担っていることが示された [51]。 フラットアース理論を保有し流通させているYoutubeチャンネルのネットワークはエコーチェンバーと評されている[20]。 しかしながら、インターネットが誕生して以来、学者たちは政治的なコミュニケーションにおける変化を見ることに好奇心を抱いていた[52]。 情報技術やその管理方法における新しい変化のために、反対する視点が民主主義においてどのように共通認識に達することができるかは不明である[53]。 エコーチェンバー効果から見られる効果は主に政治において生じることが引用されており、例えば2016年のアメリカにおける大統領選挙における Twitter[54]やFacebookがそうだった。 [19] 一部の人々は、2016年の大統領選挙においてドナルド・トランプの成功にはエコーチェンバーが大きな部分を演じたと確信していた[55]。 |

| Countermeasures From media companies Some companies have also made efforts in combating the effects of an echo chamber on an algorithmic approach. A high-profile example of this is the changes Facebook made to its "Trending" page, which is an on-site news source for its users. Facebook modified their "Trending" page by transitioning from displaying a single news source to multiple news sources for a topic or event.[56] The intended purpose of this was to expand the breadth of news sources for any given headline, and therefore expose readers to a variety of viewpoints. There are startups building apps with the mission of encouraging users to open their echo chambers, such as unFound.news.[57] Another example is a beta feature on BuzzFeed News, called "Outside Your Bubble".[58] This experiment adds a module at the bottom of BuzzFeed News articles to show reactions from various platforms, like Twitter, Facebook, and Reddit. This concept aims to bring transparency and prevent biased conversations, diversifying the viewpoints their readers are exposed to.[59] |

対策 メディア企業から いくつかの企業は、アルゴリズム的なアプローチでエコーチェンバーの影響に対抗する取り組みも行っています。有名な例としては、Facebookがユー ザー向けのニュースソースである「Trending」ページを変更したことが挙げられます。Facebookは、トピックやイベントに対して、単一の ニュースソ ースを表示することから複数のニュースソースを表示すること へと移行することで「トレンド」ページを変更した[56]。これ の目的は、任意のヘッドラインに対するニュースソースの幅 を広げ、読者に様々な視点を提供することであった。もうひとつの例は、BuzzFeed Newsのベータ機能で、「Outside Your Bubble」と呼ばれている[58]。この試みは、BuzzFeed Newsの記事の下に、Twitter、Facebook、Redditなどのさまざまなプラットフォームからの反応を表示するモジュールを追加する。こ のコンセプトは、透明性をもたらし、偏った会話を防ぎ、読者がさらされる視点を多様化させることを目的としている[59]。 |

| Solution A 2022 study focused on how one can resolve online echo chambers without surveillance of individuals. In social networks, users often engage with like-minded peers.[4] This selective exposure to opinions might result in echo chambers, i.e., political fragmentation and social polarization of user interactions. When echo chambers form, opinions have a bimodal distribution with two peaks on opposite sides. In certain issues, where either extreme positions contain a degree of misinformation, neutral consensus is preferable for promoting discourse. In a 2022 study[4] the researchers introduce the random dynamical nudge (RDN), which presents each agent with input from a random selection of other agents’ opinions and does not require surveillance of every person’s opinions. the computational results in two different models suggest that the random dynamical nudge leads to a unimodal distribution of opinions centered around the neutral consensus. Furthermore, the random dynamical nudge is effective both for preventing the formation of echo chambers and also for depolarizing existing echo chambers. Due to the simple and robust nature of the random dynamical nudge, social media networks might be able to implement a version of this self-feedback mechanism, when appropriate, to prevent the segregation of online communities on complex social issues.[4] |

解決策 2022年の研究では、個人を監視することなく、どのようにすればオンラインのエコーチェンバーを解決できるかに焦点を当てた。ソーシャルネットワークで は、ユーザーは同じ考えを持つ仲間と交流することが多い[4]。このように選択的に意見に触れることで、ユーザー間の交流が政治的に分断され社会的に偏向 する、エコーチャンバーが発生する可能性がある。エコーチェンバーが形成されると、意見は2つのピークが反対側にある二峰性の分布になる。どちらかの極端 な立場に誤報が含まれるような特定の問題では、中立的なコンセンサスが言論を促進するために望ましいとされています。2022年の研究[4]では、各エー ジェントに他のエージェントの意見をランダムに選択して入力させるランダムダイナミカルナッジ(RDN)を導入し、すべての人の意見を監視する必要がな い。2種類のモデルで計算した結果、ランダムダイナミカルナッジは、中立コンセンサスの周りに一様な意見分布を導くことが示唆された。さらに,ランダム・ ダイナミカル・ナッジはエコーチェンバーの形成を防ぐと同時に,既存のエコーチェンバーを無極化するのにも有効であることが示された.ランダム・ダイナミ カル・ナッジの単純かつ頑健な性質から、ソーシャルメディアネットワークは、複雑な社会問題に対するオンラインコミュニティの分離を防ぐために、必要に応 じてこのセルフフィードバックメカニズムのバージョンを実装することができるかもしれない[4]。 |

| Algorithmic radicalization Availability cascade Circular source Communal reinforcement False consensus effect Filter bubble Groupthink Opinion corridor Positive feedback Safe-space Selective exposure theory Splinternet Tribe (Internet) Woozle effect |

アルゴリズム的過激化 利用可能性カスケード 循環的情報源 共同体による強化 誤った合意効果 フィルターバブル 集団思考 意見回廊 正のフィードバック 安全空間 選択的露出理論 スプリネット 部族(インターネット) ウーズル効果 |

| https://en.wikipedia.org/wiki/Echo_chamber_%28media%29 |

https://www.deepl.com/ja/translator |

Echo chamber dynamics in social media as a two-step process. The first is "seeding" in which malicious actors insert misinformation into the public sphere, and second is “echoing” when people circulate it as part of their beliefs and identity.[20] / ソーシャルメディアにおけるエコーチェンバーのダイナミクスは、2段階のプロセスとして存在する。一つは悪意のあるアクターが誤った情報を公共圏に挿入す る「種まき」であり、二つ目は人々が信念やアイデンティティの一部としてそれを流通させる「エコーイング」である[20](この図のpdf )。

+++

リンク

文献

その他の情報

++

Copyleft,

CC, Mitzub'ixi Quq Chi'j, 1996-2099