AI時代において「空気」を読む研究

Trusting

Communication-Design between human and AI

AI時代において「空気」を読む研究

Trusting

Communication-Design between human and AI

池田光穂・手島勲矢

この研究は、人とAI(人工知能/汎用人工知能)、 二つの言語・思考の関係の行く末についての議論を、思想史的検証に耐えるだけの理論に鍛え上げようとするものである。そのための課題として、昨今の日本社 会における「空気が読めない」「空気を読む」と言う隠喩的表現と、社会の信頼性の基礎についての基礎研究を行う。とりわけ、現在はAI時代である。人間の あいだの「空気が読めない」「空気を読む」と言う問題設定だけではもはや限界である。人間どうし、人間とAI、そしてAIどうしのあいだの「空気が読めな い」「空気を読む」と言う問題設定が重要なのである(→「気(氣)の研究」)。

ここで空気を読むというのは、山本七平が、日本文化 において批判した《ロゴス抜きの談合コミュニケーション》のことではない(山本 2018)。むしろ、「KY=空気が読めない」ということのうちに内包されている「空気 を(適切に)読む」ということを、コミュニケーション論的に解釈して、「言語行為がおかれた文脈を読み取る=メタコンテクスト理解の判読可能性」と理解す る。そうすると、今日のAIは、その身体がないという限界性(ドレイファス 1992;Dreyfus 1979)により、「信頼」の醸成がおこなわれな い、ということになる。つまり、ここにおける日本文化論における「空気」とは、「信頼の醸成」という意味であり、「よい空気」とは、間主観的なコミュニ ケーションがなりたっている状態のことをさす。

****

《強いAI》時代とは、コンピュータ ーが人間の代わりに思考し判断を行う時代であるが、その時の「信頼」とは何かを問う思 考実験は、まさに人とAIの、言語・思考の原理的な関係について問うことであり、人類社 会の行く末を占う意味で重要な思想史的意味をもつ。特にカーツワイルの描く未来論(シ ンギュラリティ仮説)では、人の言語・思考を模倣するにとどまらず、最終的に、人の思 考・知識を凌駕する《強いAI》の出現が予言されている。しかし、はたして《人の言葉とA Iの思考》を一つの等式で結ぶことが可能なのかなど、その議論の核心には疑問が残る。人 間の頭脳を模倣するAIとは一体何を模倣しているのか、その手本となる人間の言葉とは、 人間の思考とは何かなど、多様な交錯するAIの未来像には、人文社会学の二千年以上にわ たる知的総力を結集して取り組むべき課題が多くある。本研究は、ルネサンス期・宗教改 革期におきた言語の認識の革新を参照点として、未来社会における「信頼」の課題と必要 性のヴィジョンをまとめる。

1.研究目的、研究方法など

(1)研究目的:

本研究は、AIと人、その二つの言 語・思考の関係の行く末についての議論 を、思想史的検証に耐えるだけの理論に鍛え上げようとするものである。中でも、技術的特 異点を迎えたときに、AIは人間の知能を凌駕した人工知能になるという、そのときの「信 頼」とは何かを問う思考実験は、まさに人とAIの言語・思考の関係について問うことであり、 人類社会の行く末を占う意味で重要な思想史的意味をもつ。とりわけカーツワイルの描く未 来論(シンギュラリティ仮説)では、人の言語・思考の仕組みの模倣にとどまらず、最終的 に、自らの意識をもって思考・知識を生み出す《強いAI》の出現が予言されている。しかし、 はたして人とAIの《言葉と思考》を一つの等式で結ぶことが可能なのか、人間の頭脳を模倣 するAIとは一体何を模倣しているのか、その手本となる人間の言葉とは、人間の思考とは何 かなど、根本的な疑問に応えることなく、クラウド化とともに、多様なAIの未来像が語られ る。そのアイデアの多くは近代以降の思考と用語によるもので、人類史における宗教的な言 語の知見、「数字」「文字」の原理的論争、名前をめぐる思想史的な文脈など、近代以前の 人間の思考と語彙の伝統についての深い洞察が致命的に欠けている。AI時代の社会的課題 「トラスト」は、人文社会学の二千年以上にわたる蓄積の知的総力を結集して、領域横断的 に果敢に取り組むべき課題である。にもかかわらず、横断的総合的にできないのは、これま での人文社会学の怠慢であると同時に文系/理系というこれまでの文教政策による分断のせ いでもある。

(2)研究方法:

人文社会学もAIの課題に取り組むことが可能な背景 として2つの認識を あげる。1)サピエンスは技術を生み改良し自然に働きかけ、自然を改変してきたが、その 技術力は、自然環境を理解する知的枠組みとしての言語能力の進化(3人称の認識革命)に よってもたらされた。2)どの人類社会にも言語があり、その多くは文字の文明となって神 話・古典・聖典を生み出した。現在の世界の論理操作の基盤の核心には、今もなお、その古 代の聖典や古典に由来する、宇宙や根源のイメージや文字の思考が認められる。 本研究は、〈AIの言葉〉と〈人間の言葉〉は、原理的に異なるものであり、二つは同じ言 語でないという仮定から、情報化社会のトラスト(信頼)基盤について考える必要性を説く。 AIの言語は、数値化されたデータを語彙として、そのデータの整理ロジック/アルゴリズム を文法として、一元的な「意味」伝達の記号体系を実現しようとする。だが、人の言葉は自 分の関心あるものに「名前」をつけ、それは視覚イメージを伴い、洞窟の壁に描かれ、また 岩に文字で刻まれる。それゆえに「名前」「文字」は、多元的な解釈や翻訳(イメージの拡 大や変容)を許す。その点で、人が交わす言葉は、相互批判と相互理解のコミュニケーショ ンの言葉であり、お互いの認識が相互に変えられて合意形成に至るプロセスの中で信頼が育 まれる。それに対して、特に《強いAI》は、クラウドの圧倒的なデータ量から正しい提案・ 適切な助言を医師や患者にすると期待されている。その時、患者も医者も、了承か却下かの 二択(バイナリー)状況になり、運命の明暗をわけるような事態では、その選択の余地もなくなるとも想像する。人の言葉とAIの言葉を責任の原理として追求 するときに、未来の情報 化された社会における「信頼」の一つの課題は、AIの知に対して、もはや人が真偽を問えな いことである。そのとき人間に問われるのは、自分の言葉を(強いAIが人間の言葉を超える 中で)どのように守り、どのように自己の知性を失わないでいるかである。《強いAI》時代 における信頼の担保には、それに見合う人間の側の《強い人文学的な人間の言葉の理解の努 力》が必要と考える。

2.本研究の着想に至った経緯:人とAIの言葉の対 立・緊張に相対化について

人とAIの言葉の対立・緊張も相対化できないか?な ぜなら、カーツワイル が夢見るAIの人工的な言語能力は、西洋思想史"The Divorce between the Sciences and the Humanities"(I. Berlin, Against the Current, 80-110, 1979) の中で、長年、精神科学と自然科学の統一の可能性をめぐる論争を一方的な独断で終焉させ る技術論からの発想であり、そのままの人類の未来は、極めて不安定な〈機械の言語〉のみ による価値観と、AIを受け入れない〈人間の言語〉の価値観が、原理的に対峙して 相争う状況となる。AI研究者との真摯な対話を抜きに、本研究が意味を持つこ とはないが、現時点では、まず人文社会研究の視点からAIと人間の言語の特性を明らかにす ることで、コンピューター科学者/情報科学者との対話の基盤をつくることが急務である。 それがAI時代の学問パラダイムを確立する一歩になり、学生・院生のための次世代モデル・ カリキュラムも技術系の研究グループとともに構想する道も拓ける。国内の研究者に加え、 ペンシルベニア大学・Katzセンター、イスラエル・バルイラン大学の研究者とも協力する。

3.方法論的含意;

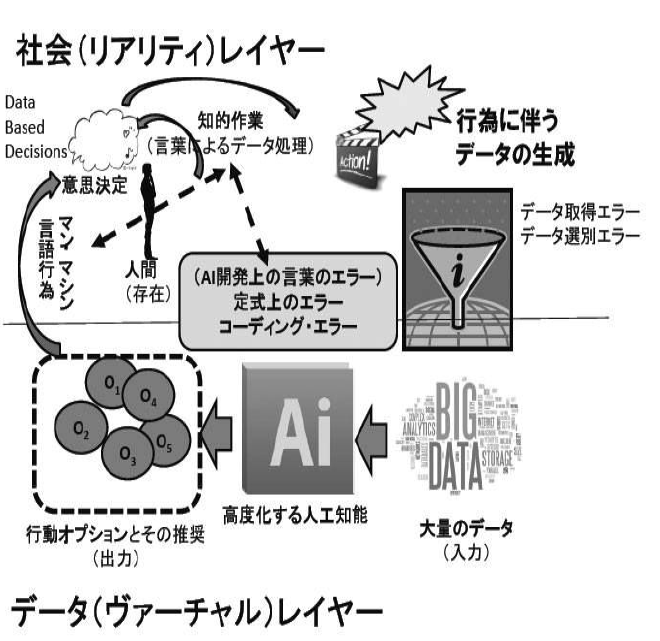

【1】現在の高度な情報社会においては、 人間が行う何らかの行為(Twitter等での言語的発話行為や思考を含む言動のすべて)は、行 為者が意識する、しないにかかわらず、記録され、データ化され、流通し、さらにビッグデ ータとして蓄積され利用される状況を生んでいる。

【2】そのデータはプログラミング言語 で記述されるプロセスの様式で結晶化され論理構造を介して人のニーズにマッチするように ソートされる。その技術がAIであり、集積されたビッグデータを元に、それは人間に推奨さ れる行動のオプションを人間世界に提示する。

【3】AIがする行為のオプション群の推奨は、 あたかもデータの言葉を人間の言葉に変換した、ある種のAIから人への言語行為と言える。

【4】それは、人間が自分の現実レイヤーを数値デー タ化して、AIのわかる言葉で人がAIに 語り掛けた結果なのであり、その人からAIへの語り掛けがヴァーチャルのレイヤーを形成し ていると言えよう。

【5】そこで問題となるのは、AIが人間の言葉や行 為のデータをもとに 提供する行為オプションの推奨は、人間が自らをデータ化してAIに語り掛けた言語的コミュ ニケーション行為とされる点で、その人からAIの語りかけの言語行為において、ある種の多 義性、言語的行為の揺れ、論理性の予断の問題が存在しないのかどうかである。

【6】この 言動リアルとヴァーチャルのレイヤーの行き来の中で、人間の使用する言語的行為の多義性、 言葉の解釈の近代的な予断、文字の論理性の振れなどがどう位置づけられるかを考えるとき、 古典学を含む人文社会学の知見が貢献することは多くのことがあると考える。シンギュラリ ティ的状況下のトラストについて考えることは、人間と強いAIとの共生の在り方について、 人類社会の現実のQOLの向上について、ヴィジョンを描くことでもあるからである。

《方法論》

|

1)人文科学的な文献収集とその批判(日本、西洋、アジア) 2)共同研究会による討論(日本)——学内外の知識人による共同研究会の組織 3)専門家のところを訪問した取材インタビュー調査(日本、アジア) 4)「空気を読む」比較文化論——フランシス・フクヤマの比較政治思想史の方法論を採用する 5)AI到来時代において「空気」を読むことは、どのように変化するのか/変わらないのか?について答申をだす |

1)人文科学的な文献収集とその批判(日本、西洋、アジア)

2)共同研究会による討論(日本)

3)専門家のところを訪問した取材インタビュー調査(日本、アジア)

4)「空気を読む」比較文化論——フランシス・フクヤマの比較政治思想史の方法論を採用する

5)AI到来時代において「空気」を読むことは、どのように変化するのか/変わらないのか?について答申をだす

本研究は、AI時代の「信頼(トラスト)」問題は、 人とAI、二つの言語の原理・文脈の区 別から考えられるべきであるという立場に立つ。レイ・カーツワイル(Ray Kurzweil, 1948- )によれば2029年には「コンピ ューターが人間並みに言語を理解する」時代が始まると予測する(wired.jp/ 2017.09.21 THU 08:30)。つまり未来の「信頼(トラスト)」の問題は、もはや人と人の間での「コミュニ ケーション」問題に限定されない。強いAIと人の関係で起きる「了解」問題も孕む複雑な 状況になると想像される。それゆえに、(1)人の言葉とAIの言葉は、原理的にどの様に違 うのか、人文学・文法学の歴史的な視点、および現在の文化人類学・社会学の視点、また科 学哲学・宗教思想の視点を交えて分析すること、(2)人間社会のリアル(語彙・名前の言 動)のレイヤーと、AIのデータ(数値・函数・アレゴリズム)のレイヤーが「接地」される とき、どの様な「信頼」問題を孕むのか、二つの記号(文字と数字)の文脈化(フレーム 化)問題他の具体例を問うこと、(3)最後に、強いAIと人の共存を可能にする、具体的な 人間知性の教育(AI時代の人文教育の諸課題)とは何かを考え始めること。これらの必要性 を思う。以下に詳述する。

クレジット:このサイトは、引用源の手島・池田「AI時代における「信頼」あるいは二つの言語と

コミュニケーションの領域横断的研究」を継承し発展させつつあるものですが、より正確には「AI時代において「空気」を読む研究: Long Version」の短縮版をなすものです。

リンク

リンク

リンク(AIと大学)

文献

その他の情報