道徳的推論

Moral reasoning

Unknown artist, Richard III

☆ 道徳的推論(Moral reasoning)とは、人が善悪についてどのように考えるか、また道徳的ルールをどのように獲得し適用するかについての研究である。道徳哲学(倫理学)と重なる道徳心理学の一分野であり、記述倫理学の基礎となる。

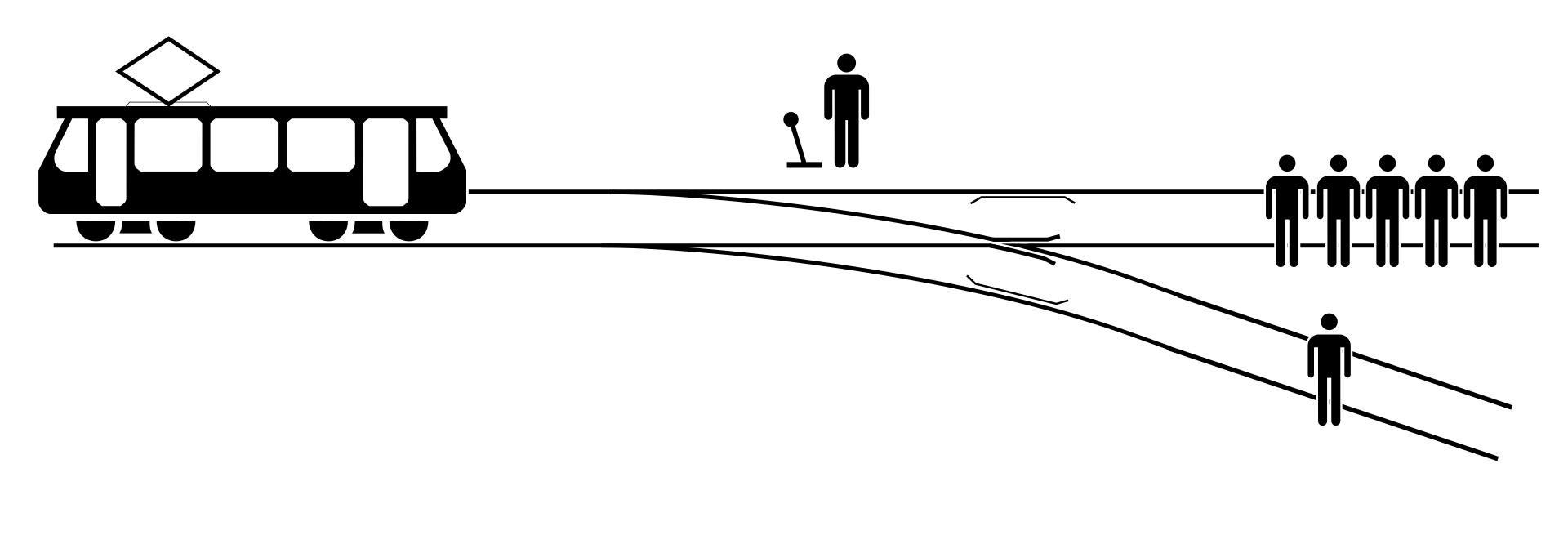

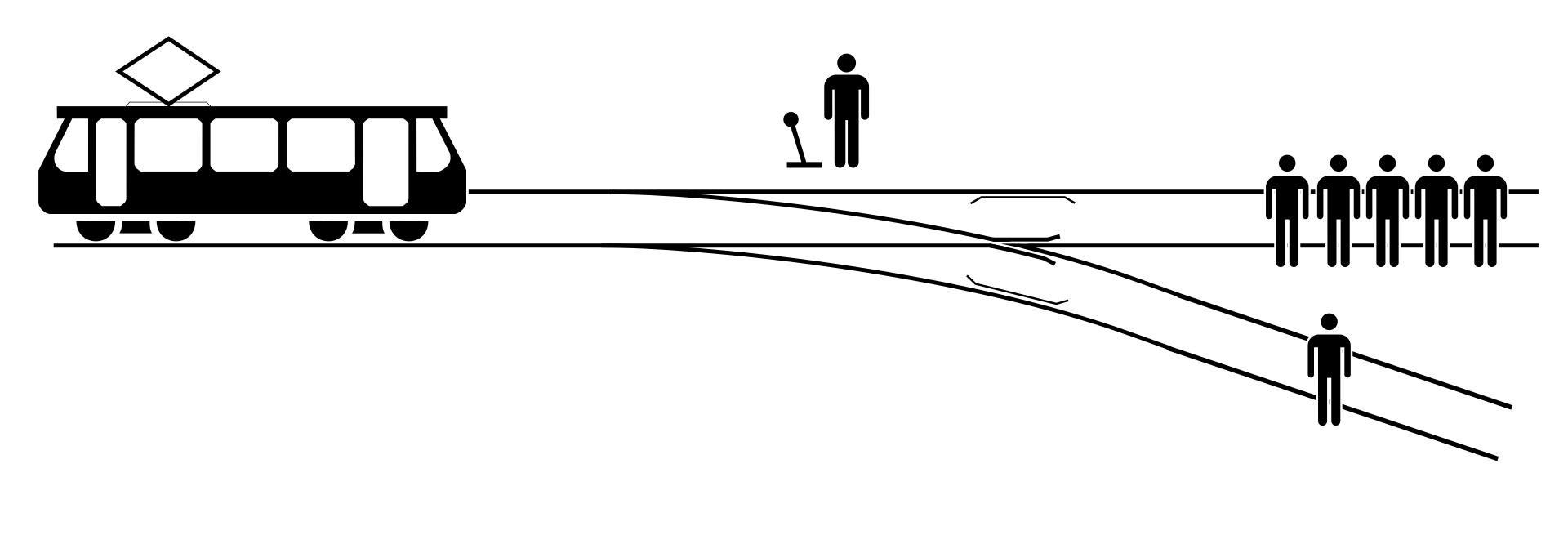

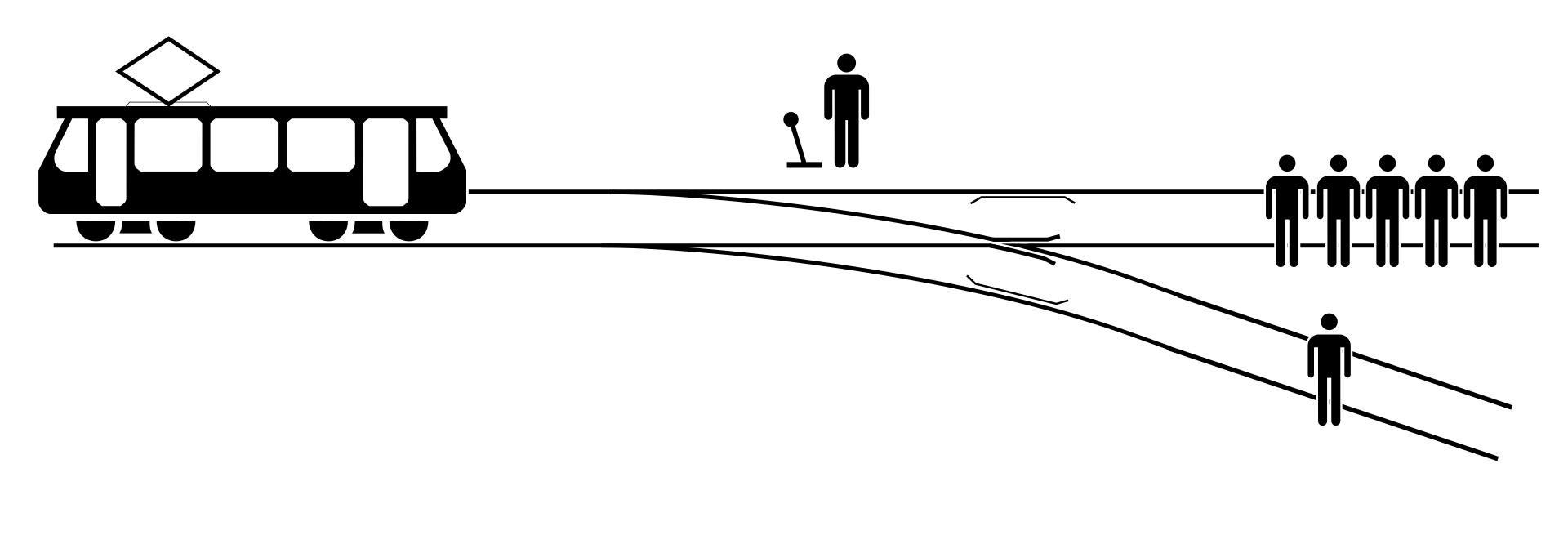

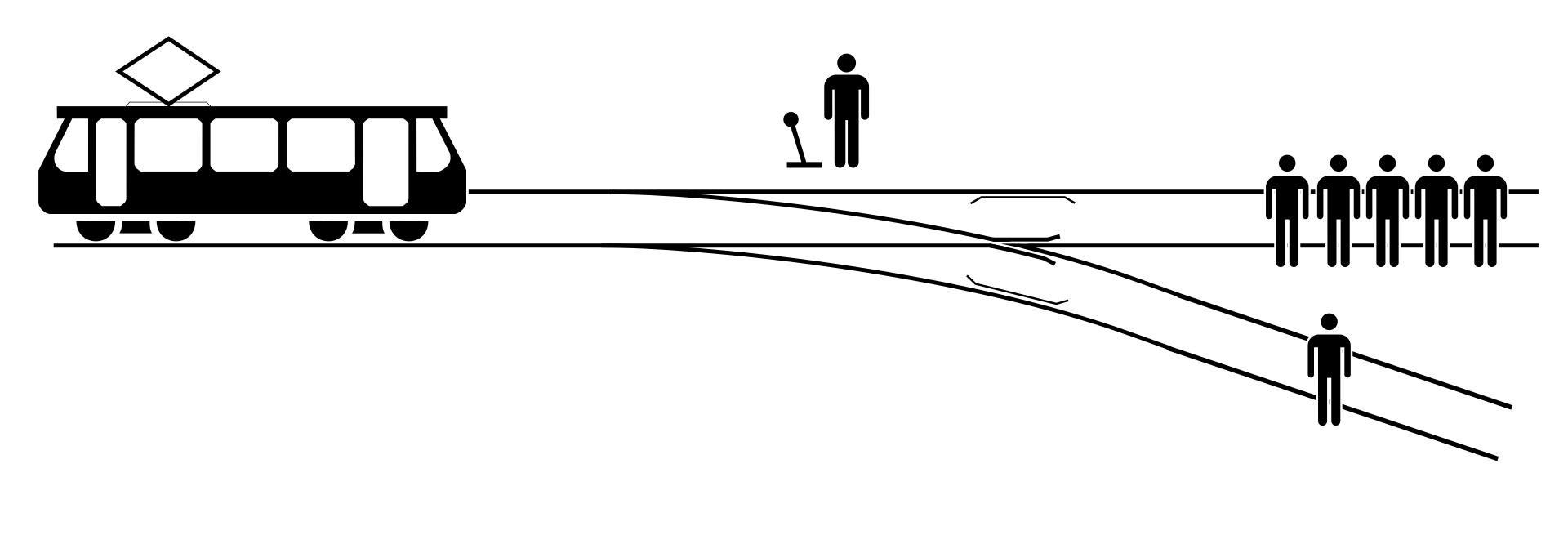

★ トロッコ問題とは、倫理学、心理学、人工知能における一連の思考実験である。このシリーズは通常、暴走した路面電車やトロッコが線路の下で何人かの人々 (伝統的には5人)と衝突して死に至るが、運転手や傍観者が介入して車両を迂回させ、別の線路で1人だけを殺すことができるというシナリオから始まる。そ の後、暴走車両の他のバリエーションや、類似の生と死のジレンマ(医療、司法など)が提示され、それぞれに、何もしない(その場合は数人が殺される)か、 介入して他の人を救うために最初の「安全な」人を1人犠牲にするかの選択肢が含まれる。

| Moral reasoning

is the study of how people think about right and wrong and how they

acquire and apply moral rules. It is a subdiscipline of moral

psychology that overlaps with moral philosophy, and is the foundation

of descriptive ethics. |

道徳的推論とは、人が善悪についてどのように考えるか、また道徳的ルー

ルをどのように獲得し適用するかについての研究である。道徳哲学と重なる道徳心理学の一分野であり、記述倫理学の基礎となる。 |

| Description Starting from a young age, people can make moral decisions about what is right and wrong. Moral reasoning, however, is a part of morality that occurs both within and between individuals.[1] Prominent contributors to this theory include Lawrence Kohlberg and Elliot Turiel. The term is sometimes used in a different sense: reasoning under conditions of uncertainty, such as those commonly obtained in a court of law. It is this sense that gave rise to the phrase, "To a moral certainty;"[2] however, this idea is now seldom used outside of charges to juries. Moral reasoning is an important and often daily process that people use when trying to do the right thing. For instance, every day people are faced with the dilemma of whether to lie in a given situation or not. People make this decision by reasoning the morality of their potential actions, and through weighing their actions against potential consequences. A moral choice can be a personal, economic, or ethical one; as described by some ethical code, or regulated by ethical relationships with others. This branch of psychology is concerned with how these issues are perceived by ordinary people, and so is the foundation of descriptive ethics. There are many different forms of moral reasoning which often are dictated by culture. Cultural differences in the high-levels of cognitive function associated with moral reasoning can be observed through the association of brain networks from various cultures and their moral decision making. These cultural differences demonstrate the neural basis that cultural influences can have on an individual's moral reasoning and decision making.[3] Distinctions between theories of moral reasoning can be accounted for by evaluating inferences (which tend to be either deductive or inductive) based on a given set of premises.[4] Deductive inference reaches a conclusion that is true based on whether a given set of premises preceding the conclusion are also true, whereas, inductive inference goes beyond information given in a set of premises to base the conclusion on provoked reflection.[4] |

解説 人は幼い頃から、何が正しくて何が間違っているのか、道徳的な判断を下すことができる。しかし、道徳的推論とは、個人内と個人間の両方で発生する道徳の一 部である[1]。この理論の著名な貢献者には、ローレンス・コールバーグとエリオット・トゥリエルが含まれる。この用語は、法廷で一般的に得られるような 不確実な条件下での推論という別の意味で使われることもある。道徳的確信に至るまで」[2]という言葉が生まれたのはこの意味からであるが、この考え方は 現在では陪審員への告発以外ではほとんど使われていない。 道徳的推論とは、人々が正しいことをしようとするときに用いる重要かつしばしば日常的なプロセスである。例えば、人々は毎日、ある状況において嘘をつくか どうかというジレンマに直面する。人は、自分の潜在的な行動の道徳性を推論し、潜在的な結果と自分の行動を天秤にかけて、この決断を下す。 道徳的な選択とは、個人的なもの、経済的なもの、倫理的なもの、何らかの倫理規範によって記述されるもの、あるいは他者との倫理的関係によって規制される ものなどがある。心理学のこの部門はこれらの問題が普通の人々によっていかに感知されるか心配する、従って記述倫理学の基礎である。道徳的推論にはさまざ まな形式があり、それはしばしば文化によって左右される。道徳的推論に関連する高レベルの認知機能における文化的差異は、様々な文化圏の脳ネットワークと 道徳的意思決定の関連性によって観察することができる。これらの文化的相違は、文化的影響が個人の道徳的推論と意思決定に及ぼしうる神経基盤を示している [3]。 演繹的推論では、結論に先行する前提のセットが真であるかどうかに基づいて真である結論に到達するのに対し、帰納的推論では、前提のセットで与えられた情 報を超えて、誘発された反省に基づいて結論に到達する[4]。 |

| In philosophy Philosopher David Hume claims that morality is based more on perceptions than on logical reasoning.[4] This means that people's morality is based more on their emotions and feelings than on a logical analysis of any given situation. Hume regards morals as linked to passion, love, happiness, and other emotions and therefore not based on reason.[4] Jonathan Haidt agrees, arguing in his social intuitionist model that reasoning concerning a moral situation or idea follows an initial intuition.[5] Haidt's fundamental stance on moral reasoning is that "moral intuitions (including moral emotions) come first and directly cause moral judgments"; he characterizes moral intuition as "the sudden appearance in consciousness of a moral judgment, including an affective valence (good-bad, like-dislike), without any conscious awareness of having gone through steps of searching, weighing evidence, or inferring a conclusion".[4] Immanuel Kant had a radically different view of morality. In his view, there are universal laws of morality that one should never break regardless of emotions.[4] He proposes a four-step system to determine whether or not a given action was moral based on logic and reason. The first step of this method involves formulating "a maxim capturing your reason for an action".[4] In the second step, one "frame[s] it as a universal principle for all rational agents".[4] The third step is assessing "whether a world based on this universal principle is conceivable".[4] If it is, then the fourth step is asking oneself "whether [one] would will the maxim to be a principle in this world".[4] In essence, an action is moral if the maxim by which it is justified is one which could be universalized. For instance, when deciding whether or not to lie to someone for one's own advantage, one is meant to imagine what the world would be like if everyone always lied, and successfully so. In such a world, there would be no purpose in lying, for everybody would expect deceit, rendering the universal maxim of lying whenever it is to your advantage absurd. Thus, Kant argues that one should not lie under any circumstance. Another example would be if trying to decide whether suicide is moral or immoral; imagine if everyone committed suicide. Since mass international suicide would not be a good thing, the act of suicide is immoral. Kant's moral framework, however, operates under the overarching maxim that you should treat each person as an end in themselves, not as a means to an end. This overarching maxim must be considered when applying the four aforementioned steps.[4] Reasoning based on analogy is one form of moral reasoning. When using this form of moral reasoning the morality of one situation can be applied to another based on whether this situation is relevantly similar: similar enough that the same moral reasoning applies. A similar type of reasoning is used in common law when arguing based upon legal precedent. [a] In consequentialism (often distinguished from deontology) actions are based as right on wrong based upon the consequences of action as opposed to a property intrinsic to the action itself. |

哲学 哲学者のデイヴィッド・ヒュームは、道徳は論理的な推論よりも知覚に基づいていると主張している[4]。ヒュームは道徳を情熱、愛、幸福、その他の感情と 結びついており、したがって理性に基づくものではないとみなしている[4]。ジョナサン・ハイドもこれに同意しており、彼の社会的直観主義モデルにおい て、道徳的状況や考えに関する推論は最初の直観に従うと主張している[5]。 [5]道徳的推論に関するハイドの基本的なスタンスは「道徳的直観(道徳的感情を含む)が最初に来て、道徳的判断を直接引き起こす」というものであり、彼 は道徳的直観を「検索、証拠の重み付け、結論の推論といった段階を経たという意識的な認識なしに、感情的価値(良い-悪い、好き-嫌い)を含む道徳的判断 が突然意識に現れること」と特徴づけている[4]。 イマニュエル・カントは道徳について根本的に異なる見解を持っていた。彼の見解では、感情に関係なく決して破ってはならない普遍的な道徳の法則が存在する [4]。彼は、論理と理性に基づいて、ある行為が道徳的かどうかを判断する4段階のシステムを提案している。この方法の最初のステップでは、「行動の理由 を捕らえた格言」を定式化する[4]。 第2のステップでは、それを「すべての合理的な主体にとっての普遍的な原理として枠にはめる[4]」[4]。 第3のステップでは、「この普遍的な原理に基づく世界が考えられるかどうか」を評価する[4]。 もし考えられるのであれば、第4のステップでは、「この世界においてその格言が原理となることを(自分が)望むかどうか」を自問する[4]。例えば、自分 の利益のために誰かに嘘をつくかどうかを決めるとき、もしすべての人が常に嘘をつき、それが成功したとしたら、世界はどうなるかを想像することになる。そ のような世界では、嘘をつくことに何の目的もなく、誰もが騙すことを期待し、自分に有利になるときはいつでも嘘をつくという普遍的な格言が不合理になる。 したがって、カントは、人はいかなる状況においても嘘をついてはならないと主張する。もう一つの例は、自殺が道徳的か非道徳的かを判断しようとする場合で ある。国際的な集団自殺は良いことではないので、自殺という行為は不道徳である。しかし、カントの道徳的枠組みは、各人を手段としてではなく、それ自体を 目的として扱うべきだという包括的な格言の下で運営されている。この包括的な最大公約数は、前述の4つのステップを適用する際に考慮されなければならない [4]。 類推に基づく推論は道徳的推論の一つの形式である。この形式の道徳的推論を使用するとき、ある状況の道徳性は、この状況が関連するほど類似しているかどう かに基づいて別の状況に適用することができます:同じ道徳的推論が適用されるのに十分似ています。コモンローでは、判例に基づいて議論するときに、同様の タイプの推論が使用される。[a] 帰結主義(しばしば脱ontologyと区別される)では、行為は、行為自体に内在する性質とは対照的に、行為の結果に基づいて善悪を判断する。 |

| In developmental psychology Moral reasoning first attracted a broad attention from developmental psychologists in the mid-to-late 20th century. Their main theorization involved elucidating the stages of development of moral reasoning capacity. Jean Piaget Jean Piaget developed two phases of moral development, one common among children and the other common among adults. The first is known as the Heteronomous Phase.[7] This phase, more common among children, is characterized by the idea that rules come from authority figures in one's life such as parents, teachers, and God.[7] It also involves the idea that rules are permanent no matter what.[7] Thirdly, this phase of moral development includes the belief that "naughty" behavior must always be punished and that the punishment will be proportional.[7] The second phase in Piaget's theory of moral development is referred to as the Autonomous Phase. This phase is more common after one has matured and is no longer a child. In this phase people begin to view the intentions behind actions as more important than their consequences.[7] For instance, if a person who is driving swerves in order to not hit a dog and then knocks over a road sign, adults are likely to be less angry at the person than if he or she had done it on purpose just for fun. Even though the outcome is the same, people are more forgiving because of the good intention of saving the dog. This phase also includes the idea that people have different morals and that morality is not necessarily universal.[7] People in the Autonomous Phase also believe rules may be broken under certain circumstances.[7] For instance, Rosa Parks broke the law by refusing to give up her seat on a bus, which was against the law but something many people consider moral nonetheless. In this phase people also stop believing in the idea of immanent justice.[7] Lawrence Kohlberg Main article: Lawrence Kohlberg's stages of moral development Inspired by Piaget, Lawrence Kohlberg made significant contributions to the field of moral reasoning by creating a theory of moral development.[8] His theory is a "widely accepted theory that provides the basis for empirical evidence on the influence of human decision making on ethical behavior."[9] In Lawrence Kohlberg's view, moral development consists of the growth of less egocentric and more impartial modes of reasoning on more complicated matters. He believed that the objective of moral education is the reinforcement of children to grow from one stage to an upper stage. Dilemma was a critical tool that he emphasized that children should be presented with; yet also, the knowledge for children to cooperate.[10] According to his theory, people pass through three main stages of moral development as they grow from early childhood to adulthood. These are pre-conventional morality, conventional morality, and post-conventional morality.[8] Each of these is subdivided into two levels.[8] The stages that are presented by Lawrence Kohlberg can be varied into three which are pre-conventional, conventional, and post-conventional where each contains two stages varying in ages. The first stage in the pre-conventional level is obedience and punishment. In this stage people, usually young children where they age from 5 to 7 years old, avoid certain behaviors only because of the fear of punishment, not because they see them as wrong. They believe that the rules are mandatory, and they like avoiding harms.[8] The second stage in the pre-conventional level is called individualism and exchange: in this stage people make moral decisions based on what best serves their needs. It happens usually during ages of 8 to 10 years old where they have some understandings that some rules are arbitrary but not consistent.[8] The third stage is part of the conventional morality level and is called interpersonal relationships. This stage ages from 10 to 12 years old where they concern about living up to expectations and reciprocity. For example, their actings are mostly motivated by their parent's praises or reactions. In this stage one tries to conform to what is considered moral by the society that they live in, attempting to be seen by peers as a good person.[8] The fourth stage is also in the conventional morality level and is called maintaining social order. Kids around this stage age between 12 and 14 where they believe conventions are arbitrary social expectations. Also, they believe moral decisions are based on fairness not rules. This stage focuses on a view of society as a whole and following the laws and rules of that society.[8] The fifth stage is a part of the post-conventional level and is called social contract and individual rights. People in this age vary from 17 to 20 which not much people are in it. They believe morality is relative to systems of laws, and they don't think any system is necessarily superior. In this stage people begin to consider differing ideas about morality in other people and feel that rules and laws should be agreed on by the members of a society.[8] The sixth and final stage of moral development, the second in the post-conventional level, is called universal principles. They usually age between 21 or older where they think what is moral are values and rights that exist prior to social attachment and contracts. At this stage people begin to develop their ideas of universal moral principles and will consider them the right thing to do regardless of what the laws of a society are.[8] James Rest In 1983, James Rest developed the four component Model of Morality, which addresses the ways that moral motivation and behavior occurs.[11] The first of these is moral sensitivity, which is "the ability to see an ethical dilemma, including how our actions will affect others".[12] The second is moral judgment, which is "the ability to reason correctly about what 'ought' to be done in a specific situation".[12] The third is moral motivation, which is "a personal commitment to moral action, accepting responsibility for the outcome".[12] The fourth and final component of moral behavior is moral character, which is a "courageous persistence in spite of fatigue or temptations to take the easy way out".[12] |

発達心理学において 道徳的推論は、20世紀半ばから後半にかけて、発達心理学者から広く注目されるようになった。彼らの主な理論化は、道徳的推論の能力の発達段階を解明する ことであった。 ジャン・ピアジェ ジャン・ピアジェは、道徳性の発達について、子どもに共通する段階と成人に共通する段階の2つを開発した。1つ目は、「他律的段階」として知られている [7]。この段階は、子どもにより一般的であり、ルールは両親、教師、神など、自分の人生における権威者からもたらされるという考えによって特徴づけられ る[7]。また、ルールは何があっても永久的なものであるという考えも含まれる[7]。3つ目に、道徳的発達のこの段階には、「いたずらな」行動は常に罰 せられなければならず、その罰は比例するという信念が含まれる[7]。 ピアジェの道徳的発達の理論における第二の段階は、自律期と呼ばれている。この段階は、人が成熟し、もはや子どもでなくなった後によく見られる。この段階 では、人は行動の背後にある意図を、その結果よりも重要視し始める[7]。例えば、運転中の人が犬にぶつからないようにハンドルを切り、道路標識を倒して しまった場合、大人は、その人が遊び半分でわざとやった場合よりも、その人に対する怒りを抑える可能性が高い。結果は同じでも、犬を助けようという善意が あるため、人々はより寛容になる。例えば、ローザ・パークスはバスで席を譲ることを拒否して法律を破ったが、これは法律違反であったが、それにもかかわら ず多くの人が道徳的なことだと考えている。この段階になると、人々は内在的正義という考え方も信じなくなる[7]。 ローレンス・コールバーグ 主な記事 ローレンス・コールバーグの道徳的発達段階 ピアジェに触発されたローレンス・コールバーグは、道徳的発達の理論を構築することによって道徳的推論の分野に大きく貢献した[8]。 彼の理論は、「人間の意思決定が倫理的行動に及ぼす影響に関する経験的証拠の基礎を提供する、広く受け入れられている理論」[9]である。ローレンス・ コールバーグの見解では、道徳的発達は、より複雑な事柄について、より自己中心的でなく、より公平な推論様式の成長から成る。彼は、道徳教育の目的は、子 どもたちがある段階から上の段階へと成長するように強化することであると考えていた。彼の理論によれば、人は幼児期から成人期へと成長する過程で、主に3 つの道徳的発達段階を経る。これらは前伝統的道徳、慣習的道徳、後伝統的道徳であり、それぞれは2つのレベルに細分化されている[8]。 ローレンス・コールバーグによって提示された段階は、前伝統的、慣習的、後伝統的の3つに分けることができ、それぞれが年齢によって異なる2つの段階を含 んでいる。前慣習的レベルの最初の段階は、服従と罰である。この段階では、通常5歳から7歳の幼い子どもたちが、罰を恐れて特定の行動を避けるのであっ て、それが間違っていると考えるからではない。彼らはルールは強制的なものであり、危害を避けることを好むと信じている[8]。前従順レベルの第2段階 は、個人主義と交換と呼ばれるものである。この段階は通常8歳から10歳の間に起こり、いくつかのルールは恣意的であるが一貫性がないことをある程度理解 している[8]。 第3段階は従来の道徳レベルの一部であり、対人関係と呼ばれる。この段階は10歳から12歳までで、期待に応えることや互恵性に関心を持つ。例えば、彼ら の行動のほとんどは、親の賞賛や反応によって動機づけられる。この段階では、自分が住んでいる社会で道徳的と考えられていることに従おうとし、仲間から良 い人と思われようとする[8]。この段階の12~14歳の子どもたちは、慣習とは恣意的な社会的期待であると考えている。また、道徳的判断は規則ではなく 公正さに基づいていると考える。この段階は、社会を全体としてとらえ、その社会の法律や規則に従うことに重点を置いている[8]。 第5段階は、ポスト慣習的レベルの一部であり、社会契約と個人の権利と呼ばれる。この年齢層は17歳から20歳までと幅が広く、あまり多くの人はこの年齢 にはいない。彼らは道徳は法制度に相対するものだと考えており、どの制度が必ずしも優れているとは考えていない。この段階では、人々は他の人々の道徳に関 する異なる考えを考慮し始め、規則や法律は社会の構成員によって合意されるべきであると感じている[8]。道徳的発達の6番目と最後の段階は、ポスト慣習 的レベルの2番目で、普遍的原理と呼ばれている。彼らは通常21歳以上で、道徳的なものとは社会的な愛着や契約よりも前に存在する価値や権利だと考える。 この段階になると、人々は普遍的な道徳原則についての考えを発展させ始め、社会の法律がどうであろうと、それを正しいと考えるようになる[8]。 ジェームズ・レスト 1983年、ジェームズ・レストは、道徳的動機づけと行動がどのように起こるかを扱う「道徳の4つの構成要素モデル」を開発した[11]。その第1は道徳 的感受性であり、「自分の行動が他者にどのような影響を与えるかを含め、倫理的ジレンマを見抜く能力」である[12]。 [12]3つ目は道徳的動機づけであり、「結果に対する責任を引き受ける道徳的行動への個人的なコミットメント」[12]である。[12]4つ目、そして 道徳的行動の最後の構成要素は道徳的性格であり、「疲労や安易な道を選びたくなる誘惑にもかかわらず、勇気を持って持続すること」[12]である。 |

| n social cognition Based on empirical results from behavioral and neuroscientific studies, social and cognitive psychologists attempted to develop a more accurate descriptive (rather than normative) theory of moral reasoning. That is, the emphasis of research was on how real-world individuals made moral judgments, inferences, decisions, and actions, rather than what should be considered as moral. Dual-process theory and social intuitionism Main articles: Dual process theory (moral psychology) and Social intuitionism Developmental theories of moral reasoning were critiqued as prioritizing on the maturation of cognitive aspect of moral reasoning.[13] From Kohlberg's perspective, one is considered as more advanced in moral reasoning as she is more efficient in using deductive reasoning and abstract moral principles to make moral judgments about particular instances.[13][14] For instance, an advanced reasoner may reason syllogistically with the Kantian principle of 'treat individuals as ends and never merely as means' and a situation where kidnappers are demanding a ransom for a hostage, to conclude that the kidnappers have violated a moral principle and should be condemned. In this process, reasoners are assumed to be rational and have conscious control over how they arrive at judgments and decisions.[13] In contrast with such view, however, Joshua Greene and colleagues argued that laypeople's moral judgments are significantly influenced, if not shaped, by intuition and emotion as opposed to rational application of rules. In their fMRI studies in the early 2000s,[15][16] participants were shown three types of decision scenarios: one type included moral dilemmas that elicited emotional reaction (moral-personal condition), the second type included moral dilemmas that did not elicit emotional reaction (moral-impersonal condition), and the third type had no moral content (non-moral condition). Brain regions such as posterior cingulate gyrus and angular gyrus, whose activation is known to correlate with experience of emotion, showed activations in moral-personal condition but not in moral-impersonal condition. Meanwhile, regions known to correlate with working memory, including right middle frontal gyrus and bilateral parietal lobe, were less active in moral-personal condition than in moral-impersonal condition. Moreover, participants' neural activity in response to moral-impersonal scenarios was similar to their activity in response to non-moral decision scenarios. Another study[14] used variants of trolley problem that differed in the 'personal/impersonal' dimension and surveyed people's permissibility judgment (Scenarios 1 and 2). Across scenarios, participants were presented with the option of sacrificing a person to save five people. However, depending on the scenario, the sacrifice involved pushing a person off a footbridge to block the trolley (footbridge dilemma condition; personal) or simply throwing a switch to redirect the trolley (trolley dilemma condition; impersonal). The proportions of participants who judged the sacrifice as permissible differed drastically: 11% (footbridge dilemma) vs. 89% (trolley dilemma). This difference was attributed to the emotional reaction evoked from having to apply personal force on the victim, rather than simply throwing a switch without physical contact with the victim. Focusing on participants who judged the sacrifice in trolley dilemma as permissible but the sacrifice in footbridge dilemma as impermissible, the majority of them failed to provide a plausible justification for their differing judgments.[14] Several philosophers have written critical responses on this matter to Joshua Greene and colleagues.[17][18][19][20]  ★One of the dilemmas included in the trolley problem: should you pull the lever to divert the runaway trolley onto the side track? Based on these results, social psychologists proposed the dual process theory of morality. They suggested that our emotional intuition and deliberate reasoning are not only qualitatively distinctive, but they also compete in making moral judgments and decisions. When making an emotionally-salient moral judgment, automatic, unconscious, and immediate response is produced by our intuition first. More careful, deliberate, and formal reasoning then follows to produce a response that is either consistent or inconsistent with the earlier response produced by intuition,[13][5][21] in parallel with more general form of dual process theory of thinking. But in contrast with the previous rational view on moral reasoning, the dominance of the emotional process over the rational process was proposed.[5][21] Haidt highlighted the aspect of morality not directly accessible by our conscious search in memory, weighing of evidence, or inference. He describes moral judgment as akin to aesthetic judgment, where an instant approval or disapproval of an event or object is produced upon perception.[5] Hence, once produced, the immediate intuitive response toward a situation or person cannot easily be overridden by the rational consideration that follows. The theory explained that in many cases, people resolve inconsistency between the intuitive and rational processes by using the latter for post-hoc justification of the former. Haidt, using the metaphor "the emotional dog and its rational tail",[5] applied such nature of our reasoning to the contexts ranging from person perception to politics. A notable illustration of the influence of intuition involved feeling of disgust. According to Haidt's moral foundations theory, political liberals rely on two dimensions (harm/care and fairness/reciprocity) of evaluation to make moral judgments, but conservatives utilize three additional dimensions (ingroup/loyalty, authority/respect, and purity/sanctity).[21][22] Among these, studies have revealed the link between moral evaluations based on purity/sanctity dimension and reasoner's experience of disgust. That is, people with higher sensitivity to disgust were more likely to be conservative toward political issues such as gay marriage and abortion.[23] Moreover, when the researchers reminded participants of keeping the lab clean and washing their hands with antiseptics (thereby priming the purity/sanctity dimension), participants' attitudes were more conservative than in the control condition.[24] In turn, Helzer and Pizarro's findings have been rebutted by two failed attempts of replications.[25] Other studies raised criticism toward Haidt's interpretation of his data.[26][27] Augusto Blasi also rebuts the theories of Jonathan Haidt on moral intuition and reasoning. He agrees with Haidt that moral intuition plays a significant role in the way humans operate. However, Blasi suggests that people use moral reasoning more than Haidt and other cognitive scientists claim. Blasi advocates moral reasoning and reflection as the foundation of moral functioning. Reasoning and reflection play a key role in the growth of an individual and the progress of societies.[28] Alternatives to these dual-process/intuitionist models have been proposed, with several theorists proposing that moral judgment and moral reasoning involves domain general cognitive processes, e.g., mental models,[29] social learning [30][31][32] or categorization processes.[33] Motivated reasoning Main article: Motivated reasoning A theorization of moral reasoning similar to dual-process theory was put forward with emphasis on our motivations to arrive at certain conclusions.[34] Ditto and colleagues[35] likened moral reasoners in everyday situations to lay attorneys than lay judges; people do not reason in the direction from assessment of individual evidence to moral conclusion (bottom-up), but from a preferred moral conclusion to assessment of evidence (top-down). The former resembles the thought process of a judge who is motivated to be accurate, unbiased, and impartial in her decisions; the latter resembles that of an attorney whose goal is to win a dispute using partial and selective arguments.[21][35] Kunda proposed motivated reasoning as a general framework for understanding human reasoning.[34] She emphasized the broad influence of physiological arousal, affect, and preference (which constitute the essence of motivation and cherished beliefs) on our general cognitive processes including memory search and belief construction. Importantly, biases in memory search, hypothesis formation and evaluation result in confirmation bias, making it difficult for reasoners to critically assess their beliefs and conclusions. It is reasonable to state that individuals and groups will manipulate and confuse reasoning for belief depending on the lack of self control to allow for their confirmation bias to be the driving force of their reasoning. This tactic is used by media, government, extremist groups, cults, etc. Those with a hold on information may dull out certain variables that propagate their agenda and then leave out specific context to push an opinion into the form of something reasonable to control individual, groups, and entire populations. This allows the use of alternative specific context with fringe content to further veer from any form of dependability in their reasoning. Leaving a fictional narrative in the place of real evidence for a logical outlook to form a proper, honest, and logical assessment .[34] Applied to moral domain, our strong motivation to favor people we like leads us to recollect beliefs and interpret facts in ways that favor them. In Alicke (1992, Study 1),[36] participants made responsibility judgments about an agent who drove over the speed limit and caused an accident. When the motive for speeding was described as moral (to hide a gift for his parents' anniversary), participants assigned less responsibility to the agent than when the motive was immoral (to hide a vial of cocaine). Even though the causal attribution of the accident may technically fall under the domain of objective, factual understanding of the event, it was nevertheless significantly affected by the perceived intention of the agent (which was presumed to have determined the participants' motivation to praise or blame him). Another paper by Simon, Stenstrom, and Read (2015, Studies 3 and 4)[37] used a more comprehensive paradigm that measures various aspects of participants' interpretation of a moral event, including factual inferences, emotional attitude toward agents, and motivations toward the outcome of decision. Participants read about a case involving a purported academic misconduct and were asked to role-play as a judicial officer who must provide a verdict. A student named Debbie had been accused of cheating in an exam, but the overall situation of the incident was kept ambiguous to allow participants to reason in a desired direction. Then, the researchers attempted to manipulate participants' motivation to support either the university (conclude that she cheated) or Debbie (she did not cheat) in the case. In one condition, the scenario stressed that through previous incidents of cheating, the efforts of honest students have not been honored and the reputation of the university suffered (Study 4, Pro-University condition); in another condition, the scenario stated that Debbie's brother died from a tragic accident a few months ago, eliciting participants' motivation to support and sympathize with Debbie (Study 3, Pro-Debbie condition). Behavioral and computer simulation results showed an overall shift in reasoning—factual inference, emotional attitude, and moral decision—depending on the manipulated motivation. That is, when the motivation to favor the university/Debbie was elicited, participants' holistic understanding and interpretation of the incident shifted in the way that favored the university/Debbie. In these reasoning processes, situational ambiguity was shown to be critical for reasoners to arrive at their preferred conclusion.[34][37][38] From a broader perspective, Holyoak and Powell interpreted motivated reasoning in the moral domain as a special pattern of reasoning predicted by coherence-based reasoning framework.[39] This general framework of cognition, initially theorized by the philosopher Paul Thagard, argues that many complex, higher-order cognitive functions are made possible by computing the coherence (or satisfying the constraints) between psychological representations such as concepts, beliefs, and emotions.[40] Coherence-based reasoning framework draws symmetrical links between consistent (things that co-occur) and inconsistent (things that do not co-occur) psychological representations and use them as constraints, thereby providing a natural way to represent conflicts between irreconcilable motivations, observations, behaviors, beliefs, and attitudes, as well as moral obligations.[37][39] Importantly, Thagard's framework was highly comprehensive in that it provided a computational basis for modeling reasoning processes using moral and non-moral facts and beliefs as well as variables related to both 'hot' and 'cold' cognitions.[39][40][41] Causality and intentionality Classical theories of social perception had been offered by psychologists including Fritz Heider (model of intentional action)[42] and Harold Kelley (attribution theory).[43] These theories highlighted how laypeople understand another person's action based on their causal knowledge of internal (intention and ability of actor) and external (environment) factors surrounding that action. That is, people assume a causal relationship between an actor's disposition or mental states (personality, intention, desire, belief, ability; internal cause), environment (external cause), and the resulting action (effect). In later studies, psychologists discovered that moral judgment toward an action or actor is critically linked with these causal understanding and knowledge about the mental state of the actor. Bertram Malle and Joshua Knobe conducted survey studies to investigate laypeople's understanding and use (the folk concept) of the word 'intentionality' and its relation to action.[44] His data suggested that people think of intentionality of an action in terms of several psychological constituents: desire for outcome, belief about the expected outcome, intention to act (combination of desire and belief), skill to bring about the outcome, and awareness of action while performing that action. Consistent with this view as well as with our moral intuitions, studies found significant effects of the agent's intention, desire, and beliefs on various types of moral judgments, Using factorial designs to manipulate the content in the scenarios, Cushman showed that the agent's belief and desire regarding a harmful action significantly influenced judgments of wrongness, permissibility, punishment, and blame. However, whether the action actually brought about negative consequence or not only affected blame and punishment judgments, but not wrongness and permissibility judgments.[45][46] Another study also provided neuroscientific evidence for the interplay between theory of mind and moral judgment.[47] Through another set of studies, Knobe showed a significant effect in the opposite direction: Intentionality judgments are significantly affected by the reasoner's moral evaluation of the actor and action.[48][49] In one of his scenarios, a CEO of a corporation hears about a new programme designed to increase profit. However, the program is also expected to benefit or harm the environment as a side effect, to which he responds by saying 'I don't care'. The side effect was judged as intentional by the majority of participants in the harm condition, but the response pattern was reversed in the benefit condition. Many studies on moral reasoning have used fictitious scenarios involving anonymous strangers (e.g., trolley problem) so that external factors irrelevant to researcher's hypothesis can be ruled out. However, criticisms have been raised about the external validity of the experiments in which the reasoners (participants) and the agent (target of judgment) are not associated in any way.[50][51] As opposed to the previous emphasis on evaluation of acts, Pizarro and Tannenbaum stressed our inherent motivation to evaluate the moral characters of agents (e.g., whether an actor is good or bad), citing the Aristotelian virtue ethics. According to their view, learning the moral character of agents around us must have been a primary concern for primates and humans beginning from their early stages of evolution, because the ability to decide whom to cooperate with in a group was crucial to survival.[50][52] Furthermore, observed acts are no longer interpreted separately from the context, as reasoners are now viewed as simultaneously engaging in two tasks: evaluation (inference) of moral character of agent and evaluation of her moral act. The person-centered approach to moral judgment seems to be consistent with results from some of the previous studies that involved implicit character judgment. For instance, in Alicke's (1992)[36] study, participants may have immediately judged the moral character of the driver who sped home to hide cocaine as negative, and such inference led the participants to assess the causality surrounding the incident in a nuanced way (e.g., a person as immoral as him could have been speeding as well).[52] In order to account for laypeople's understanding and use of causal relations between psychological variables, Sloman, Fernbach, and Ewing proposed a causal model of intentionality judgment based on Bayesian network.[53] Their model formally postulates that character of agent is a cause for the agent's desire for outcome and belief that action will result in consequence, desire and belief are causes for intention toward action, and the agent's action is caused by both that intention and the skill to produce consequence. Combining computational modeling with the ideas from theory of mind research, this model can provide predictions for inferences in bottom-up direction (from action to intentionality, desire, and character) as well as in top-down direction (from character, desire, and intentionality to action). |

社会的認知において 行動学的、神経科学的研究からの経験的な結果に基づいて、社会心理学者や認知心理学者は、道徳的推論のより正確な記述的(規範的ではなく)理論の開発を試 みた。つまり、何が道徳的とみなされるべきかよりも、現実世界の個人がどのように道徳的判断、推論、決定、行動を行うかに研究の重点が置かれた。 二重過程理論と社会的直観主義 主な記事 二重過程理論(道徳心理学)と社会的直観主義 道徳的推論の発達理論は、道徳的推論の認知的側面の成熟を優先していると批判された[13]。コールバーグの観点からは、特定の事例について道徳的判断を 下すために演繹的推論や抽象的な道徳原理を使用することがより効率的であるため、道徳的推論においてより高度であると見なされる。 [13][14] 例えば、高度な推論者は、「個人を目的として扱い、決して単に手段として扱わない」というカント的原則と、誘拐犯が人質の身代金を要求している状況とを対 義的に推論し、誘拐犯は道徳的原則に違反しており、非難されるべきであると結論づけることができる。このプロセスにおいて、理性者は合理的であり、どのよ うに判断や決定に至るかを意識的にコントロールしていると仮定される[13]。 しかし、このような見方とは対照的に、ジョシュア・グリーンと同僚たちは、素人の道徳的判断は、合理的なルールの適用とは対照的に、直感や感情に大きく影 響されると主張した。2000年代初頭に行われたfMRI研究[15][16]では、被験者に3種類の意思決定シナリオが示された。1種類は感情的反応を 引き起こす道徳的ジレンマを含むもの(道徳的-個人的条件)、2種類目は感情的反応を引き起こさない道徳的ジレンマを含むもの(道徳的-非道徳的条件)、 3種類目は道徳的内容を含まないもの(非道徳的条件)であった。後帯状回や角回などの脳領域は、感情経験と相関することが知られているが、道徳的-個人的 条件では活性化を示したが、道徳的-非道徳的条件では示さなかった。一方、右中前頭回や両側頭頂葉など、ワーキングメモリとの相関が知られている領域は、 道徳的-人格的条件では道徳的-非人格的条件よりも活性が低かった。さらに、道徳的-非道徳的シナリオに対する参加者の神経活動は、非道徳的な意思決定シ ナリオに対する参加者の活動と類似していた。 別の研究[14]では、「個人的/非個人的」次元の異なるトロッコ問題の変種を用い、人々の容認性判断を調査した(シナリオ1および2)。シナリオ全体を 通じて、参加者は5人を救うために1人を犠牲にするという選択肢を提示された。しかし、シナリオによって、犠牲には、トロッコを妨害するために歩道橋から 人を突き落とすこと(歩道橋のジレンマ条件;個人的)や、トロッコを方向転換させるために単にスイッチを投げること(トロッコのジレンマ条件;非人間的) が含まれた。犠牲が許されると判断した参加者の割合は大きく異なった: 11%(歩道橋のジレンマ)対89%(トロッコのジレンマ)であった。この差は、犠牲者と物理的な接触をせずに単にスイッチを投げるのではなく、犠牲者に 個人的な力を加えなければならないことから呼び起こされる感情的な反応に起因している。トロッコのジレンマにおける犠牲は許されるが、歩道橋のジレンマに おける犠牲は許されないと判断した参加者に焦点を当てると、彼らの大多数は、その判断の違いについてもっともらしい正当化理由を提示することができなかっ た[14]。この件について、何人かの哲学者がジョシュア・グリーンらに対して批判的な回答を書いている[17][18][19][20]。  ★トロッコ問題に含まれるジレンマのひとつは、暴走するトロッコを側線に迂回させるためにレバーを引くべきか? これらの結果に基づいて、社会心理学者は道徳の二重過程理論を提唱した。彼らは、私たちの感情的直観と熟慮的推論は質的に異なるだけでなく、道徳的判断や 決定を下す際に競合することを示唆した。感情的な道徳的判断を下す際には、自動的、無意識的、即時的な反応がまず直感によって生み出される。その後、より 注意深く、熟慮された、形式的な推論が続き、直感によって先に生み出された反応と一致するか矛盾するかのいずれかの反応を生み出す[13][5] [21]。しかし、道徳的な推論に関する以前の合理的な見解とは対照的に、合理的なプロセスよりも感情的なプロセスの優位性が提案された[5][21]。 ハイドは、記憶、証拠の重み付け、推論における私たちの意識的な検索では直接アクセスできない道徳性の側面を強調した。彼は道徳的判断を美的判断に似てい ると表現しており、そこではある出来事や物体を知覚したときに即座に賛否が生じる[5]。それゆえ、いったん生じた状況や人物に対する直感的な反応は、そ の後に続く理性的な検討によって簡単に覆されることはない。この理論では、多くの場合、人は直観的なプロセスと合理的なプロセスの間の矛盾を、後者を用い て前者を事後的に正当化することで解決していると説明した。ヘイトは、「感情的な犬と理性的な尻尾」という比喩を用いて[5]、このような私たちの推論の 性質を、人の知覚から政治に至るまでの文脈に適用した。 直観の影響の顕著な例として、嫌悪感が挙げられる。Haidtの道徳的基盤理論によると、政治的リベラル派は道徳的判断を下す際に2つの次元(危害/ケ ア、公正/互恵性)の評価に依存するが、保守派はさらに3つの次元(イングループ/忠誠、権威/尊敬、純粋性/神聖性)を利用する[21][22]。この うち、純粋性/神聖性の次元に基づく道徳的評価と理性者の嫌悪感の経験との関連性が研究で明らかにされている。すなわち、嫌悪感に対する感受性が高い人ほ ど、同性婚や中絶などの政治的問題に対して保守的である傾向が強かった[23]。さらに、研究者が研究室を清潔に保ち、消毒薬で手を洗うことを参加者に思 い出させると(それによって純粋性/神聖性の次元がプライミングされた)、参加者の態度は対照条件よりも保守的であった[24]。 アウグスト・ブラシもまた、道徳的直観と推論に関するジョナサン・ハイドの理論に反論している[26][27]。彼は、道徳的直観が人間の行動様式におい て重要な役割を果たしていることに同意している。しかし、Blasiは、Haidtや他の認知科学者が主張する以上に、人々は道徳的推論を使用しているこ とを示唆している。ブラジは道徳的機能の基礎として道徳的推論と内省を提唱している。推論と内省は個人の成長と社会の進歩において重要な役割を果たす [28]。 これらの二重過程/直観主義モデルに対する代替案が提案されており、いくつかの理論家は道徳的判断と道徳的推論が領域一般的認知過程、例えばメンタルモデ ル、[29] 社会的学習[30][31][32]またはカテゴリー化過程[33]を含むことを提案している。 動機づけされた推論 主な記事 動機づけされた推論 Dittoと同僚[35]は日常的な状況における道徳的推論者を一般裁判官よりも一般弁護士になぞらえた;人々は個々の証拠の評価から道徳的結論へ(ボト ムアップ)ではなく、好ましい道徳的結論から証拠の評価へ(トップダウン)という方向で推論する。前者は、彼女の決定において正確で、公平で、公平である ことを動機とする裁判官の思考プロセスに似ており、後者は、部分的で選択的な論拠を用いて紛争に勝つことを目標とする弁護士の思考プロセスに似ている [21][35]。 クンダは、人間の推論を理解するための一般的な枠組みとして動機付 き推論を提案した[34]。クンダは、生理学的覚醒、感情、選好(動機付けと大切 にしている信念の本質を構成する)が、記憶検索や信念構築などの一般的な認 知過程に広く影響を及ぼすことを強調した。重要なのは、記憶検索、仮説形成、評価におけるバイアスが確証バイアスをもたらし、推論者が自分の信念や結論を 批判的に評価することを難しくしていることである。確証バイアスが推論の原動力となるような自己統制の欠如によって、個人や集団は推論を操作し、信念と混 同すると述べるのは妥当である。この手口は、メディア、政府、過激派グループ、カルトなどが使う。情報を握っている人たちは、自分たちのアジェンダを広め る特定の変数を除外し、特定の文脈を省いて、個人、集団、集団全体をコントロールするために、ある意見を合理的な形に押し込めることがある。これによっ て、フリンジ的な内容の代替的な特定の文脈を使用することができ、彼らの推論におけるいかなる形の信頼性からもさらに逸脱することができる。適切で、正直 で、論理的な評価を形成するための論理的展望のために、現実の証拠の代わりに架空の物語を残す。 道徳的な領域に当てはめると、好きな人に好意を抱こうとする強い動機 が、私たちに信念を思い出させ、その人に好意を抱くように事実を解釈 させる。Alicke(1992、研究1)[36]では、参加者は制限速度を超えて運転し、 事故を引き起こした行為者について責任判断を行った。スピード違反の動機が道徳的なもの(両親の記念日に贈るプレゼントを隠すため)であると説明された場 合、参加者は、動機が非道徳的なもの(コカインの小瓶を隠すため)であった場合よりも、その行為者にあまり責任を割り当てなかった。事故の原因帰属は、厳 密には客観的で事実的な出来事の理解の領域に属するかもしれないが、それにもかかわらず、代理人の知覚された意図(これは、参加者が代理人を賞賛したり非 難したりする動機を決定したと推定される)に大きく影響された。 Simon、Stenstrom、Readによる別の論文(2015年、研究3と4)[37]では、より包括的なパラダイムを用いて、事実推論、代理人に 対する感情的態度、意思決定の結果に対する動機など、参加者の道徳的出来事の解釈の様々な側面を測定している。参加者は、学業上の不正行為とされる事件を 読み、評決を下さなければならない司法官としてロールプレイするよう求められた。デビーという学生が試験でカンニングをしたと告発されたが、参加者が望ま しい方向に推論できるように、事件の全体的な状況は曖昧にされた。そして研究者たちは、この事件で大学側(彼女はカンニングをしたと結論づける)かデビー (彼女はカンニングをしていない)のどちらかを支持しようとする参加者の動機を操作しようと試みた。ある条件では、シナリオで、過去のカンニング事件を通 じて、誠実な学生の努力が報われず、大学の評判が落ちたことを強調し(研究4、大学支持条件)、別の条件では、シナリオで、デビーの兄が数ヶ月前に悲惨な 事故で亡くなったことを述べ、参加者のデビーを支持し、同情する動機を引き出した(研究3、デビー支持条件)。行動とコンピュータ・シミュレーションの結 果、操作された動機によって、推論-事実推論、感情的態度、道徳的判断が全体的に変化することが示された。すなわち、大学/デビーに有利な動機が引き出さ れたとき、参加者の事件の全体的理解と解釈は、大学/デビーに有利な方向にシフトした。これらの推論プロセスにおいて、状況の曖昧さは推論者が好ましい結 論に到達するために重要であることが示された[34][37][38]。 より広い観点から、ホリオークとパウエルは道徳的領域における動機づけ推論をコヒーレンスに基づく推論の枠組みによって予測される推論の特別なパターンと して解釈した[39]。この認知の一般的な枠組みは哲学者のポール・タガードによって最初に理論化され、多くの複雑で高次の認知機能が概念、信念、感情な どの心理的表現間のコヒーレンス(または制約を満たすこと)を計算することによって可能になると主張している。 [コヒーレンスベースの推論フレームワークは、一貫性のある(共起するもの)心理的表現と一貫性のない(共起しないもの)心理的表現の間に対称的なリンク を引き、それらを制約として使用し、それによって両立しない動機、観察、行動、信念、態度、および道徳的義務の間の葛藤を表現する自然な方法を提供する。 [37][39]重要なことは、Thagardのフレームワークは、道徳的・非道徳的な事実や信念、また「ホットな」認知と「コールドな」認知の両方に関 連する変数を使用して推論プロセスをモデル化するための計算基礎を提供するという点で非常に包括的であった[39][40][41]。 因果性と意図性 フリッツ・ハイダー(意図的行動のモデル)[42]やハロルド・ケリー(帰属理論)[43]を含む心理学者によって社会的認知の古典的な理論が提供されて いた。これらの理論は、その行動を取り巻く内的要因(行為者の意図と能力)と外的要因(環境)の因果的知識に基づいて、素人が他人の行動をどのように理解 するかを強調した。つまり、人々は行為者の気質や精神状態(性格、意図、願望、信念、能力;内的原因)、環境(外的原因)、そして結果として生じる行動 (結果)の間に因果関係があると仮定する。その後の研究で心理学者たちは、行為や行為者に対する道徳的判断は、こうした因果関係の理解や行為者の精神状態 に関する知識と決定的に結びついていることを発見した。 バートラム・マレとジョシュア・ノベは、「意図性」という言葉の一般人の理解や使用(民間概念)と行為との関係を調査するために調査研究を行った [44]。彼のデータは、人々が行為の意図性をいくつかの心理的構成要素、すなわち結果に対する欲求、期待される結果についての信念、行為意図(欲求と信 念の組み合わせ)、結果をもたらす技能、その行為を行う際の行為意識から考えていることを示唆した。クッシュマンは、シナリオの内容を操作する要因計画を 用いて、有害な行為に関するエージェントの信念と欲求が、不正、許容、罰、非難の判断に有意に影響することを示した。しかし、その行動が実際に否定的な結 果をもたらすかどうかは、非難と罰の判断に影響するだけで、悪意と許 容性の判断には影響しなかった[45][46]。別の研究でも、心の理論と道徳的判断の相互作用に関 する神経科学的証拠が示されている[47]。 別の一連の研究によって、ノベは逆方向の有意な効果を示した: 意図性判断は行為者と行為に対する理性者の道徳的評 価に大きく影響される。しかし、そのプログラムは副次的な効果として環境に利益や害をもたらすことも予想され、それに対して彼は「気にしない」と答える。 この副作用は、害を与える条件では大多数の参加者が意図的なものと判断したが、利益を与える条件では逆の反応パターンとなった。 道徳的推論に関する研究の多くは、研究者の仮説とは無関係な外的要因を排除できるように、匿名の他人を含む架空のシナリオ(例えば、トロッコ問題)を用い ている。しかし、推論者(参加者)と行為者(判断対象)が何ら関連していない実験の外的妥当性については批判が提起されている[50][51]。行為の評 価に重点が置かれていた従来の実験とは対照的に、ピサロとタネンバウムは、アリストテレス的な徳倫理学を引用して、行為者の道徳的性格(例えば、行為者が 善人か悪人か)を評価しようとする人間の固有の動機を強調した。彼らの見解によれば、集団の中で誰と協力するかを決定する能力は生存にとって極めて重要で あったため、周囲の行為者の道徳的性格を学習することは霊長類や人間にとって進化の初期段階から主要な関心事であったに違いない[50][52]。さら に、観察された行為はもはや文脈から切り離して解釈されることはなく、推論者は現在、行為者の道徳的性格の評価(推論)と行為者の道徳的行為の評価という 2つのタスクに同時に従事していると見なされている。道徳的判断に対するパーソンセンタード・アプローチは、暗黙の人格判断に関する先行研究の結果とも一 致しているように思われる。例えば、Alicke(1992)[36]の研究では、参加者はコカインを隠すために家まで急発進した運転者の道徳的性格を否 定的であると即座に判断した可能性があり、そのような推論によって参加者は事件を取り巻く因果関係をニュアンス的に評価するようになった(例えば、彼と同 じくらい不道徳な人物が同様にスピード違反をしていた可能性がある)[52]。 スロマン、ファーンバック、ユーイングは、心理学的変数間の因果 関係の素人の理解と利用を説明するために、ベイジアンネットワークに基 づいた意図性判断の因果モデルを提案した[53]。彼らのモデルは、 エージェントの性格が結果に対するエージェントの欲求と行動が結 果をもたらすという信念の原因であり、欲求と信念が行動に対する意 思の原因であり、エージェントの行動はその意図と結果を生み出す 技能の両方によって引き起こされると公式に仮定している。計算論的モデリングと心の理論研究のアイデアを組み合わせることで、このモデルは、ボトムアップ 方向(行動から意図性、欲求、性格へ)の推論だけでなく、トップダウン方向(性格、欲求、意図性から行動へ)の推論も予測することができる。 |

| Gender difference At one time psychologists believed that men and women have different moral values and reasoning. This was based on the idea that men and women often think differently and would react to moral dilemmas in different ways. Some researchers hypothesized that women would favor care reasoning, meaning that they would consider issues of need and sacrifice, while men would be more inclined to favor fairness and rights, which is known as justice reasoning.[54] However, some also knew that men and women simply face different moral dilemmas on a day-to-day basis and that might be the reason for the perceived difference in their moral reasoning.[54] With these two ideas in mind, researchers decided to do their experiments based on moral dilemmas that both men and women face regularly. To reduce situational differences and discern how both genders use reason in their moral judgments, they therefore ran the tests on parenting situations, since both genders can be involved in child rearing.[54] The research showed that women and men use the same form of moral reasoning as one another and the only difference is the moral dilemmas they find themselves in on a day-to-day basis.[54] When it came to moral decisions both men and women would be faced with, they often chose the same solution as being the moral choice. At least this research shows that a division in terms of morality does not actually exist, and that reasoning between genders is the same in moral decisions. |

ジェンダーの違い かつて心理学者は、男性と女性では道徳的価値観や理性が異なると考えていた。これは、男性と女性では考え方が異なることが多く、道徳的ジレンマに対して異 なる反応を示すという考えに基づいていた。一部の研究者は、女性はケア推論、つまり必要性や犠牲の問題を考慮することを好むが、男性は正義推論として知ら れる公平性や権利を好む傾向が強いという仮説を立てた[54]。しかし、一部の研究者は、男女が単に日常的に異なる道徳的ジレンマに直面しており、それが 道徳的推論において認識される違いの理由かもしれないということも知っていた[54]。これら2つの考えを念頭に置いて、研究者は男女の両方が定期的に直 面する道徳的ジレンマに基づいて実験を行うことにした。状況的な差異を減らし、男女のジェンダーの両方が道徳的判断においてどのように理性を使うかを見極 めるために、研究者たちは男女ともに子育てに関わる可能性があるため、子育ての場面でテストを行った[54]。研究の結果、女性も男性も互いに同じ形の道 徳的理性を使い、唯一の違いは日常的に直面する道徳的ジレンマであることがわかった[54]。男女ともに道徳的判断に直面すると、道徳的な選択として同じ 解決策を選ぶことが多かった。少なくともこの研究は、道徳的な観点からの区分は実際には存在せず、道徳的な決定においてジェンダー間の推論は同じであるこ とを示している。 |

| https://en.wikipedia.org/wiki/Moral_reasoning |

|

- One of the dilemmas included in the trolley problem: should you pull the lever to divert the runaway trolley onto the side track? The trolley problem is a series of thought experiments in ethics, psychology and artificial intelligence involving stylized ethical dilemmas of whether to sacrifice one person to save a larger number. The series usually begins with a scenario in which a runaway tram or trolley is on course to collide with and kill a number of people (traditionally five) down the track, but a driver or bystander can intervene and divert the vehicle to kill just one person on a different track. Then other variations of the runaway vehicle, and analogous life-and-death dilemmas (medical, judicial, etc.) are posed, each containing the option to either do nothing, in which case several people will be killed, or intervene and sacrifice one initially "safe" person to save the others. Opinions on the ethics of each scenario turn out to be sensitive to details of the story that may seem immaterial to the abstract dilemma. The question of formulating a general principle that can account for the differing judgments arising in different variants of the story was raised in 1967 as part of an analysis of debates on abortion and the doctrine of double effect by the English philosopher Philippa Foot.[1] Later dubbed "the trolley problem" by Judith Jarvis Thomson in a 1976 article that catalyzed a large literature, the subject refers to the meta-problem of why different judgements are arrived at in particular instances. The most basic version of the dilemma, out of which many trolley cases, examples, dilemmas, or scenarios have evolved, is known as "Bystander at the Switch" or "Switch": There is a runaway trolley barreling down the railway tracks. Ahead, on the tracks, there are five people tied up and unable to move. The trolley is headed straight for them. You are standing some distance off in the train yard, next to a lever. If you pull this lever, the trolley will switch to a different set of tracks. However, you notice that there is one person on the side track. You have two (and only two) options: Do nothing, in which case the trolley will kill the five people on the main track. Pull the lever, diverting the trolley onto the side track where it will kill one person. Which is the more ethical option? Or, more simply: What is the right thing to do? Philosophers Judith Thomson,[2][3] Frances Kamm,[4] and Peter Unger have also analysed the dilemma extensively.[5] Thomson's 1976 article initiated the literature on the trolley problem as a subject in its own right. Characteristic of this literature are colorful and increasingly absurd alternative scenarios in which the sacrificed person is instead pushed onto the tracks as a way to stop the trolley, has his organs harvested to save transplant patients, or is killed in more indirect ways that complicate the chain of causation and responsibility. Earlier forms of individual trolley scenarios antedated Foot's publication. Frank Chapman Sharp included a version in a moral questionnaire given to undergraduates at the University of Wisconsin in 1905. In this variation, the railway's switchman controlled the switch, and the lone individual to be sacrificed (or not) was the switchman's child.[6][7] German philosopher of law Karl Engisch discussed a similar dilemma in his habilitation thesis in 1930, as did German legal scholar Hans Welzel in a work from 1951.[8][9] In his commentary on the Talmud, published long before his death in 1953, Avrohom Yeshaya Karelitz considered the question of whether it is ethical to deflect a projectile from a larger crowd toward a smaller one.[10] Similarly, in The Strike, a television play broadcast in the United States on June 7, 1954, a commander in the Korean War must choose between ordering an air strike on an encroaching enemy force at the cost of his own 20-man patrol unit, or calling off the strike and risking the lives of the main army made up of 500 men.[11] Beginning in 2001, the trolley problem and its variants have been used in empirical research on moral psychology. It has been a topic of popular books.[12] Trolley-style scenarios also arise in discussing the ethics of autonomous vehicle design, which may require programming to choose whom or what to strike when a collision appears to be unavoidable.[13] |

- トロッコ問題に含まれるジレンマのひとつは、暴走するトロッコを側線に迂回させるためにレバーを引くべきか? トロッコ問題とは、倫理学、心理学、人工知能における一連の思考実験である。このシリーズは通常、暴走した路面電車やトロッコが線路の下で何人かの人々 (伝統的には5人)と衝突して死に至るが、運転手や傍観者が介入して車両を迂回させ、別の線路で1人だけを殺すことができるというシナリオから始まる。そ の後、暴走車両の他のバリエーションや、類似の生と死のジレンマ(医療、司法など)が提示され、それぞれに、何もしない(その場合は数人が殺される)か、 介入して他の人を救うために最初の「安全な」人を1人犠牲にするかの選択肢が含まれる。 各シナリオの倫理に関する意見は、抽象的なジレンマには重要でないと思われるストーリーの細部に敏感であることが判明した。1967年、英国の哲学者フィ リッパ・フットによって、中絶と二重効力の教義に関する議論の分析の一環として、この物語のさまざまなバリエーションで生じる異なる判断を説明できる一般 原則を定式化する問題が提起された[1]。後にジュディス・ジャービス・トムソンが1976年に発表した論文で「トロッコ問題」と呼ばれ、大きな文献の きっかけとなったこのテーマは、特定の事例で異なる判断が下されるのはなぜかというメタ問題を指している。 このジレンマの最も基本的なバージョンは、多くのトロッコのケース、例、ジレンマ、あるいはシナリオが発展したもので、「スイッチの傍観者」あるいは「ス イッチ」として知られている: 線路を暴走するトロッコがある。前方の線路には、縛られて身動きできない5人の人々がいる。トロッコはまっすぐ彼らに向かっている。あなたは少し離れた車 両基地のレバーの横に立っている。このレバーを引くと、トロッコは別の線路に切り替わる。しかし、脇の線路に人が1人いることに気づく。あなたには2つの 選択肢がある(2つしかない): 何もしない。その場合、トロッコはメインの線路にいる5人を殺してしまう。 レバーを引き、トロッコを側線に迂回させ、そこで1人を殺す。 どちらがより倫理的な選択肢だろうか?あるいは、もっと単純に: どうするのが正しいのか? 哲学者のジュディス・トムソン[2][3]、フランシス・カム[4]、ピーター・アンガーもこのジレンマを幅広く分析している[5]。トムソンの1976 年の論文は、トロッコ問題をそれ自体のテーマとして扱う文献を創始した。この文献の特徴は、犠牲になった人がトロッコを止める方法として線路に突き落とさ れたり、移植患者を救うために臓器が摘出されたり、因果関係と責任の連鎖を複雑にするようなもっと間接的な方法で殺されたりするという、カラフルでますま す不条理な代替シナリオである。 個々のトロッコのシナリオの初期の形式は、フットの出版より前にあった。フランク・チャップマン・シャープは、1905年にウィスコンシン大学の学部生を 対象に行った道徳のアンケートに、このシナリオを取り入れた。このバリエーションでは、鉄道のスイッチマンがスイッチを制御しており、犠牲になる(あるい は犠牲にならない)唯一の個人はスイッチマンの子供であった[6][7]。ドイツの法哲学者カール・エンギッシュは1930年のリハビリテーション論文で 同様のジレンマについて論じており、ドイツの法学者ハンス・ウェルツェルも1951年の著作で同様のジレンマについて論じている。 [8][9]アヴローム・イェシャヤ・カレリッツは、1953年の死よりずっと前に出版されたタルムードの注釈書の中で、より大きな集団から発射された投射物をより小さな集団へと逸らすことが倫理的に許されるかどうかという問題を考察した。 [10] 同様に、1954年6月7日に米国で放送されたテレビ劇『The Strike』では、朝鮮戦争の司令官が、自分の20人の哨戒部隊を犠牲にして侵攻してくる敵軍に空爆を命じるか、空爆を中止して500人からなる主力部 隊の命を危険にさらすかの選択を迫られる[11]。 2001年以降、トロッコ問題とその変種は道徳心理学の実証的研究に用いられている。また、トロッコ型のシナリオは、衝突が避けられないと思われる場合 に、誰を、あるいは何を攻撃するかを選択するプログラミングを必要とするかもしれない自律走行車の設計の倫理を議論する際にも生じる[12]。 |

| Original dilemma Foot's version of the thought experiment, now known as "Trolley Driver", ran as follows: Suppose that a judge or magistrate is faced with rioters demanding that a culprit be found for a certain crime and threatening otherwise to take their own bloody revenge on a particular section of the community. The real culprit being unknown, the judge sees himself as able to prevent the bloodshed only by framing some innocent person and having him executed. Beside this example is placed another in which a pilot whose airplane is about to crash is deciding whether to steer from a more to a less inhabited area. To make the parallel as close as possible, it may rather be supposed that he is the driver of a runaway tram, which he can only steer from one narrow track on to another; five men are working on one track and one man on the other; anyone on the track he enters is bound to be killed. In the case of the riots, the mob have five hostages, so that in both examples, the exchange is supposed to be one man's life for the lives of five.[1] A utilitarian view asserts that it is obligatory to steer to the track with one man on it. According to classical utilitarianism, such a decision would be not only permissible, but, morally speaking, the better option (the other option being no action at all).[14] This fact makes diverting the trolley obligatory. An alternative viewpoint is that since moral wrongs are already in place in the situation, moving to another track constitutes a participation in the moral wrong, making one partially responsible for the death when otherwise no one would be responsible. An opponent of action may also point to the incommensurability of human lives. Under some interpretations of moral obligation, simply being present in this situation and being able to influence its outcome constitutes an obligation to participate. If this is the case, then doing nothing would be considered an immoral act. |

オリジナルのジレンマ 現在では「トロッコ運転手」として知られるこの思考実験のフット版は、次のようなものだった: ある裁判官か判事が、暴徒たちがある犯罪の犯人を見つけるよう要求し、さもなければ地域社会の特定の部分に流血の復讐をすると脅しているのに直面したとす る。真犯人は不明であるため、裁判官は無実の人間に濡れ衣を着せて処刑させることでしか、流血を防ぐことはできないと考える。この例の横には、飛行機が墜 落しそうになっているパイロットが、人の多い地域から少ない地域へと舵を切るかどうかを決めるという別の例が置かれている。平行線を可能な限り近づけるた めに、パイロットは暴走する路面電車の運転手であり、狭い線路から別の線路へと舵を切ることしかできない。暴動の場合、暴徒は5人の人質を取っているの で、どちらの例でも、5人の命と1人の命が交換されることになっている[1]。 功利主義的な考え方は、一人の人間が乗っている線路にハンドルを切ることが義務であると主張する。古典的功利主義によれば、そのような決定は許されるだけ でなく、道徳的に言えば、より良い選択肢である(他の選択肢は全く行動しないことである)[14]。別の視点としては、この状況では道徳的過ちがすでに存 在しているので、別の線路に移動することは道徳的過ちに参加することになり、そうでなければ誰も責任を負わないはずの死に対して部分的に責任を負うことに なるというものである。行為の反対派はまた、人命の不可分性を指摘することもある。ある道徳的義務の解釈の下では、この状況に存在し、その結果に影響を与 えることができるというだけで、参加する義務があるということになる。もしそうであれば、何もしないことは不道徳な行為とみなされるだろう。 |

| Empirical research See also: Moral psychology and Dual process theory (moral psychology) In 2001, Joshua Greene and colleagues published the results of the first significant empirical investigation of people's responses to trolley problems.[15] Using functional magnetic resonance imaging, they demonstrated that "personal" dilemmas (like pushing a man off a footbridge) preferentially engage brain regions associated with emotion, whereas "impersonal" dilemmas (like diverting the trolley by flipping a switch) preferentially engaged regions associated with controlled reasoning. On these grounds, they advocate for the dual-process account of moral decision-making. Since then, numerous other studies have employed trolley problems to study moral judgment, investigating topics like the role and influence of stress,[16] emotional state,[17] impression management,[18] levels of anonymity,[19] different types of brain damage,[20] physiological arousal,[21] different neurotransmitters,[22] and genetic factors[23] on responses to trolley dilemmas. Trolley problems have been used as a measure of utilitarianism, but their usefulness for such purposes has been widely criticized.[24][25][26] In 2017, a group led by Michael Stevens performed the first realistic trolley-problem experiment, where subjects were placed alone in what they thought was a train-switching station, and shown footage that they thought was real (but was actually prerecorded) of a train going down a track, with five workers on the main track, and one on the secondary track; the participants had the option to pull the lever to divert the train toward the secondary track. Most of the participants did not pull the lever.[27][better source needed] Survey data The trolley problem has been the subject of many surveys in which about 90% of respondents have chosen to kill the one and save the five.[28] If the situation is modified where the one sacrificed for the five was a relative or romantic partner, respondents are much less likely to be willing to sacrifice the one life.[29] A 2009 survey by David Bourget and David Chalmers shows that 68% of professional philosophers would switch (sacrifice the one individual to save five lives) in the case of the trolley problem, 8% would not switch, and the remaining 24% had another view or could not answer.[30] Criticism In a 2014 paper published in the Social and Personality Psychology Compass,[24] researchers criticized the use of the trolley problem, arguing, among other things, that the scenario it presents is too extreme and unconnected to real-life moral situations to be useful or educational.[31] In her 2017 paper, Nassim JafariNaimi[32] lays out the reductive nature of the trolley problem in framing ethical problems that serves to uphold an impoverished version of utilitarianism. She argues that the popular argument that the trolley problem can serve as a template for algorithmic morality is based on fundamentally flawed premises that serve the most powerful with potentially dire consequences on the future of cities.[33] In 2017, in his book On Human Nature, Roger Scruton criticises the usage of ethical dilemmas such as the trolley problem and their usage by philosophers such as Derek Parfit and Peter Singer as ways of illustrating their ethical views. Scruton writes, "These 'dilemmas' have the useful character of eliminating from the situation just about every morally relevant relationship and reducing the problem to one of arithmetic alone." Scruton believes that just because one would choose to change the track so that the train hits the one person instead of the five does not mean that they are necessarily a consequentialist. As a way of showing the flaws in consequentialist responses to ethical problems, Scruton points out paradoxical elements of belief in utilitarianism and similar beliefs. He believes that Nozick's experience machine thought experiment definitively disproves hedonism.[34] In his 2017 article The Trolley Problem and the Dropping of Atomic Bombs, Masahiro Morioka considers the dropping of atomic bombs as an example of the trolley problem and points out that there are five "problems of the trolley problem", namely, 1) rarity, 2) inevitability, 3) safety zone, 4) possibility of becoming a victim, and 5) the lack of perspective of the dead victims who were deprived of freedom of choice.[35] In a 2018 article published in Psychological Review, researchers pointed out that, as measures of utilitarian decisions, sacrificial dilemmas such as the trolley problem measure only one facet of proto-utilitarian tendencies, namely permissive attitudes toward instrumental harm, while ignoring impartial concern for the greater good. As such, the authors argued that the trolley problem provides only a partial measure of utilitarianism.[25] |

実証研究 こちらもご覧ください: 道徳心理学と二重過程理論(道徳心理学) 2001年、ジョシュア・グリーン(Joshua Greene)らは、トロッコ問題に対する人々の反応に関する初めての重要な実証的研究の結果を発表した[15]。彼らは機能的磁気共鳴画像法を用いて、 「個人的な」ジレンマ(歩道橋から人を突き落とすような場合)には情動に関連する脳領域が優先的に関与するのに対し、「非人間的な」ジレンマ(スイッチを 切り替えてトロッコを迂回させるような場合)には統制された推論に関連する領域が優先的に関与することを実証した。これらの理由から、彼らは道徳的意思決 定に関する二重過程説を提唱した。それ以来、他の多くの研究がトロッコ問題を道徳的判断の研究に用い、トロッコのジレンマに対する反応におけるストレス、 [16]感情状態、[17]印象管理、[18]匿名性のレベル、[19]さまざまなタイプの脳損傷、[20]生理的覚醒、[21]さまざまな神経伝達物 質、[22]遺伝的要因[23]などの役割や影響を調査している。 トロッコ問題は功利主義の尺度として用いられてきたが、そのような目的での有用性は広く批判されてきた[24][25][26]。 2017年、マイケル・スティーブンス率いるグループは、初めて現実的なトロッコ問題実験を行った。そこでは、被験者は列車交換駅と思われる場所に一人で 置かれ、列車が線路を下り、5人の作業員が主線路に、1人の作業員が副線路にいる、本物だと思われる(しかし実際には事前に録画された)映像を見せられ た。参加者のほとんどはレバーを引かなかった[27][要出典]。 調査データ このトロッコ問題は多くの調査の対象になっており、回答者の約90%が1人を殺して5人を救うことを選択している[28]。5人のために犠牲になる1人が 親族や恋愛相手であるという状況に修正を加えると、回答者は1人の命を犠牲にすることを厭わない可能性がはるかに低くなる[29]。 David BourgetとDavid Chalmersによる2009年の調査によれば、専門家である哲学者の68%がトロッコ問題の場合に転向(5人の命を救うために1人を犠牲にする)し、 8%が転向せず、残りの24%が別の見解を持っているか答えられなかった[30]。 批判 2014年にSocial and Personality Psychology Compassに掲載された論文[24]において、研究者たちはトロッコ問題の利用を批判し、とりわけ、トロッコ問題が提示するシナリオは極端すぎて現実 の道徳的状況とは無縁であり、有用でも教育的でもないと主張している[31]。 2017年の論文において、Nassim JafariNaimi[32]は、トロッコ問題が倫理的問題の枠組みにおいて還元的な性質を持っており、貧弱なバージョンの功利主義を支持するのに役 立っていると述べている。彼女は、トロッコ問題がアルゴリズム道徳のテンプレートとして役立つという一般的な議論は、都市の未来に悲惨な結果をもたらす可 能性のある最も強力な者に奉仕する根本的に欠陥のある前提に基づいていると主張している[33]。 2017年、ロジャー・スクルトンは著書『人間の本性について』の中で、トロッコ問題のような倫理的ジレンマの用法と、デレク・パーフィットやピーター・ シンガーといった哲学者が彼らの倫理観を説明する方法として用いていることを批判している。スクルトンは、「これらの 「ジレンマ 」は、状況から道徳的に関連するあらゆる関係を排除し、問題を算術だけの問題に還元するという有用な性質を持っている」と書いている。スクルトンは、列車 が5人ではなく1人にぶつかるように線路を変えることを選んだからといって、その人が必ずしも結果論者であるとは限らないと考えている。倫理的問題に対す る結果主義的対応の欠陥を示す方法として、スクルトンは功利主義や類似の信念の逆説的要素を指摘している。彼はノージックの経験機械の思考実験が快楽主義 を決定的に否定していると考えている。 [34] 森岡正博は2017年の論文The Trolley Problem and the Dropping of Atomic Bombs(原爆投下とトロッコ問題)において、原爆投下をトロッコ問題の一例とみなし、1)希少性、2)必然性、3)安全地帯、4)犠牲者になる可能 性、5)選択の自由を奪われた死者の視点の欠如という5つの「トロッコ問題の問題点」があると指摘している[35]。 Psychological Review』誌に掲載された2018年の論文において、研究者たちは、功利主義的意思決定の尺度として、トロッコ問題のような犠牲的ジレンマは、原始的 功利主義的傾向の一面、すなわち、より大きな善に対する公平な関心を無視する一方で、道具的危害に対する寛容な態度を測定しているに過ぎないと指摘した。 そのため著者らは、トロッコ問題は功利主義の部分的な尺度しか提供しないと主張した[25]。 |

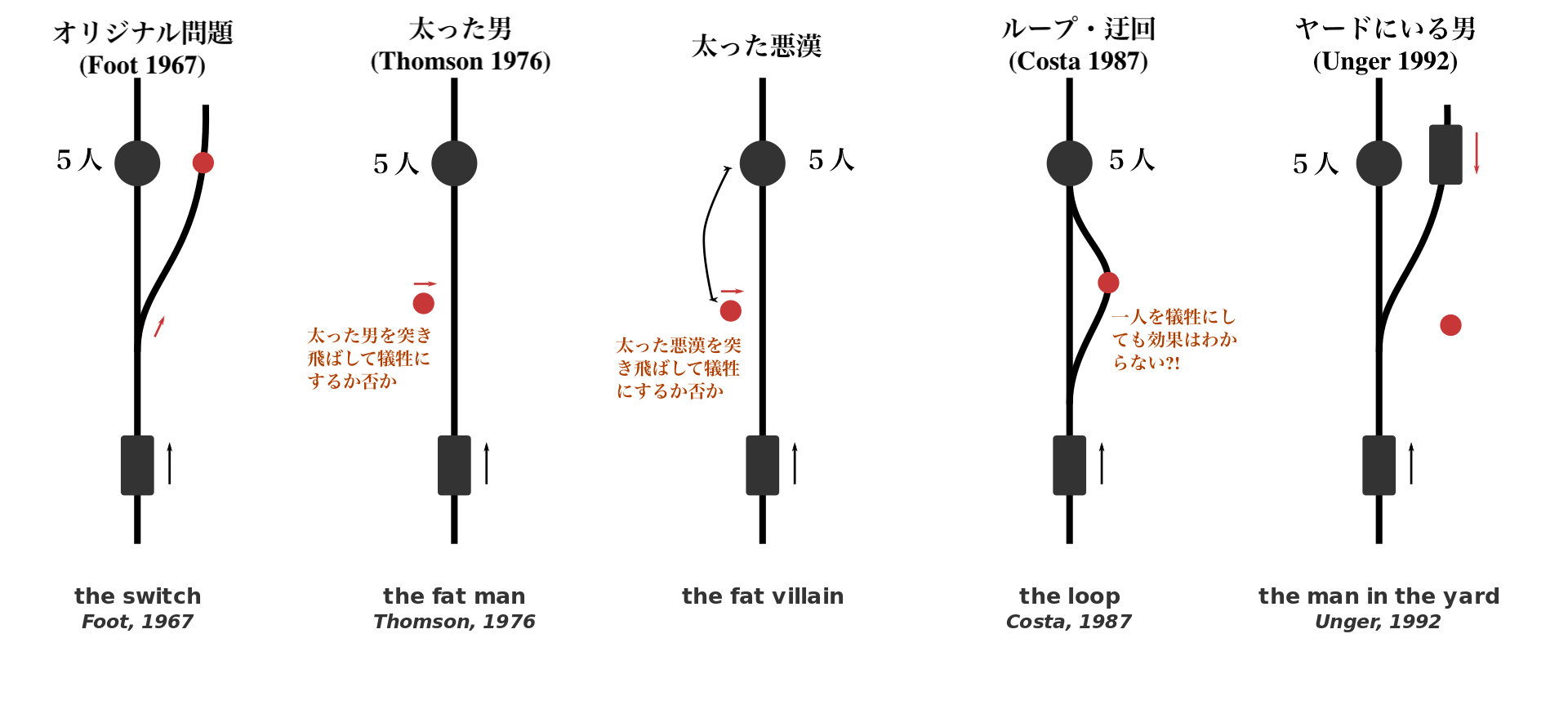

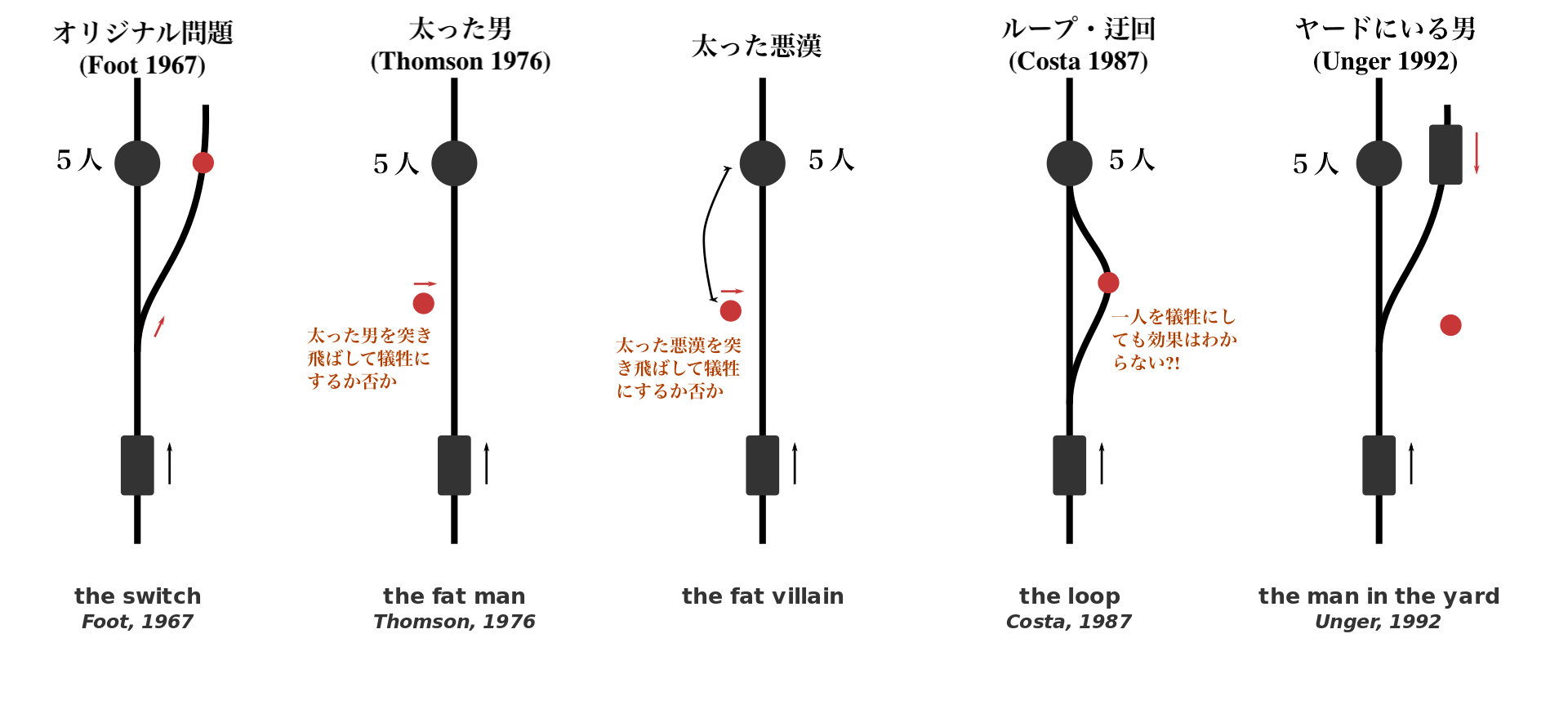

Related problems Five cases of the trolley problem: the original Switch, the Fat Man, the Fat Villain, the Loop, and the Man in the Yard Trolley problems highlight the difference between deontological and consequentialist ethical systems. The central question that these dilemmas bring to light is on whether or not it is right to actively inhibit the utility of an individual if doing so produces a greater utility for other individuals.[13] The basic Switch form of the trolley problem also supports comparison to other, related dilemmas: The Fat Man As before, a trolley is hurtling down a track towards five people. You are on a bridge under which it will pass, and you can stop it by putting something very heavy in front of it. As it happens, there is a fat man next to you – your only way to stop the trolley is to push him over the bridge and onto the track, killing him to save five. Should you proceed? Resistance to this course of action seems strong; when asked, a majority of people will approve of pulling the switch to save a net of four lives, but will disapprove of pushing the fat man to save a net of four lives.[36] This has led to attempts to find a relevant moral distinction between the two cases. One possible distinction could be that in the first case, one does not intend harm towards anyone – harming the one is just a side effect of switching the trolley away from the five. However, in the second case, harming the one is an integral part of the plan to save the five. This solution is essentially an application of the doctrine of double effect, which says that one may take action that has bad side effects, but deliberately intending harm (even for good causes) is wrong. So, the action is permissible even if the harm to the innocent person is foreseen, so long as it is not intended. This is an argument which Shelly Kagan considers (and ultimately rejects) in his first book The Limits of Morality.[37] |

関連問題 トロッコ問題の5つのケース:オリジナルのスイッチ、太った男、太った悪役、ループ、ヤードにいる男 トロッコ問題は、脱自律主義的倫理体系と結果主義的倫理体系の違いを浮き彫りにする。これらのジレンマが浮き彫りにする中心的な問題は、ある個人の効用を 積極的に阻害することが、他の個人にとってより大きな効用を生み出すのであれば、それが正しいかどうかということである[13]。 トロッコ問題の基本的なSwitchの形式は、他の関連するジレンマとの比較もサポートしている: 太った男 先ほどと同様に、トロッコが5人の人々に向かって線路を疾走している。あなたはトロッコが通過する橋の下にいて,トロッコの前に非常に重いものを置くこと でトロッコを止めることができる.偶然にも、あなたの隣に太った男がいる。トロッコを止める唯一の方法は、彼を橋の上から線路に突き落とし、5人を救うた めに彼を殺すことだ。あなたは進むべきか? この行動に対する抵抗は強いようである。尋ねてみると、過半数の人が、4人の命を救うためにスイッチを引くことには賛成するが、4人の命を救うために太っ た男を押すことには反対する[36]。このことから、この2つのケースの間に関連する道徳的区別を見つけようとする試みがなされてきた。 可能性のある区別の一つは、最初のケースでは、人は誰に対しても危害を加えるつもりはない-1人に危害を加えることは、5人からトロッコを切り離すことの 副次的効果にすぎない-ということである。しかし、2つ目のケースでは、1人を傷つけることは5人を救う計画の不可欠な部分である。この解決策は本質的に 二重効果の原則の応用であり、悪い副作用のある行動を取ることはできるが、故意に危害を加えることを意図することは(たとえ善意のためであっても)間違っ ているというものである。つまり、罪のない人への危害が予見されたとしても、それが意図されたものでない限り、その行為は許されるということだ。これは、 シェリー・ケーガンが処女作『道徳の限界』で考察している(そして最終的には否定している)議論である[37]。 |

| Implications for autonomous

vehicles Variants of the original Trolley Driver dilemma arise in the design of software to control autonomous cars.[13] Situations are anticipated where a potentially fatal collision appears to be unavoidable, but in which choices made by the car's software, such as into whom or what to crash, can affect the particulars of the deadly outcome. For example, should the software value the safety of the car's occupants more, or less, than that of potential victims outside the car.[38][39][40][41] A platform called Moral Machine[42] was created by MIT Media Lab to allow the public to express their opinions on what decisions autonomous vehicles should make in scenarios that use the trolley problem paradigm. Analysis of the data collected through Moral Machine showed broad differences in relative preferences among different countries.[43] Other approaches make use of virtual reality to assess human behavior in experimental settings.[44][45][46][47] However, some argue that the investigation of trolley-type cases is not necessary to address the ethical problem of driverless cars, because the trolley cases have a serious practical limitation. It would need to be top-down plan in order to fit the current approaches of addressing emergencies in artificial intelligence.[48] Also, a question remains of whether the law should dictate the ethical standards that all autonomous vehicles must use, or whether individual autonomous car owners or drivers should determine their car's ethical values, such as favoring safety of the owner or the owner's family over the safety of others.[13] Although most people would not be willing to use an automated car that might sacrifice themselves in a life-or-death dilemma, some[who?] believe the somewhat counterintuitive claim that using mandatory ethics values would nevertheless be in their best interest. According to Gogoll and Müller, "the reason is, simply put, that [personalized ethics settings] would most likely result in a prisoner’s dilemma."[49] In 2016, the German government appointed a commission to study the ethical implications of autonomous driving.[50][51] The commission adopted 20 rules to be implemented in the laws that will govern the ethical choices that autonomous vehicles will make.[51]: 10–13 Relevant to the trolley dilemma is this rule: 8. Genuine dilemmatic decisions, such as a decision between one human life and another, depend on the actual specific situation, incorporating “unpredictable” behaviour by parties affected. They can thus not be clearly standardized, nor can they be programmed such that they are ethically unquestionable. Technological systems must be designed to avoid accidents. However, they cannot be standardized to a complex or intuitive assessment of the impacts of an accident in such a way that they can replace or anticipate the decision of a responsible driver with the moral capacity to make correct judgements. It is true that a human driver would be acting unlawfully if he killed a person in an emergency to save the lives of one or more other persons, but he would not necessarily be acting culpably. Such legal judgements, made in retrospect and taking special circumstances into account, cannot readily be transformed into abstract/general ex ante appraisals and thus also not into corresponding programming activities. …[51]: 11 |

自律走行車への影響 潜在的に致命的な衝突が避けられないように見えるが、誰に衝突するか、何に衝突するかなど、車のソフトウェアが行う選択が致命的な結果の詳細に影響を及ぼ す可能性がある状況が想定される[13]。例えば、ソフトウエアは車の乗員の安全を、車外の潜在的な犠牲者の安全よりも高く評価すべきか、あるいは低く評 価すべきか。 Moral Machine[42]と呼ばれるプラットフォームがMITメディアラボによって作成され、トロッコ問題のパラダイムを使用するシナリオにおいて自律走行 車がどのような決定を下すべきかについて一般市民が意見を表明できるようにした。Moral Machineを通じて収集されたデータを分析したところ、国によって相対的な選好に大きな違いがあることが示された[43]。実験的な設定で人間の行動 を評価するために仮想現実を利用するアプローチもある[44][45][46][47]。しかし、トロッコ型のケースの調査は、ドライバーレスカーの倫理 的問題に対処するために必要ではないと主張する者もいる。人工知能における緊急事態に対処する現在のアプローチに適合させるためには、トップダウン型の計 画が必要となる[48]。 また、すべての自律走行車が使用しなければならない倫理基準を法律が規定するべきか、それとも個々の自律走行車の所有者や運転者が、他人の安全よりも所有 者や所有者の家族の安全を優先するなど、自分の車の倫理的価値を決定すべきかという疑問も残る[13]。ほとんどの人は生死に関わるジレンマで自分を犠牲 にするかもしれない自動運転車を使いたがらないだろうが、それにもかかわらず強制的な倫理的価値を使用することが最善の利益になるという、やや直感に反す る主張を信じる[誰?GogollとMüllerによれば、「その理由は、簡単に言えば、[パーソナライズされた倫理設定は]囚人のジレンマに陥る可能性 が高いからである」[49]。 2016年、ドイツ政府は自律走行の倫理的意味合いを研究する委員会を任命した[50][51]。委員会は自律走行車が行う倫理的選択を規定する法律に実 装される20のルールを採択した[51]: 10-13 トロッコのジレンマに関連するのはこのルールである: 8. 人の命と別の命との間の決断のような真のジレンマ的決断は、実際の具体的状況に依存し、影響を受ける当事者による「予測不可能な」行動が組み込まれる。し たがって、明確に標準化することはできないし、倫理的に疑いのないようにプログラムすることもできない。技術システムは事故を回避するように設計されなけ ればならない。しかし、正しい判断を下す道徳的能力を備えた責任あるドライバーの判断に取って代わるような、あるいはそれを先取りするような方法で、事故 の影響を複雑かつ直感的に評価するような標準化はできない。たしかに、人間のドライバーが緊急時に人を殺して他の1人以上の命を救おうとすれば、違法行為 となるが、必ずしも有責行為とはならない。このような法的判断は、特別な状況を考慮した上で遡及的になされるものであり、抽象的/一般的な事前評価には容 易に変換できず、したがって対応するプログラミング活動にも変換できない。...[51]: 11 |

| https://en.wikipedia.org/wiki/Moral_reasoning |

|

リ ンク

文 献

そ の他の情報

Copyleft, CC, Mitzub'ixi Quq Chi'j, 1996-2099

☆ ☆

☆