人工痴呆の研究

On Artifial dementia

人工痴呆の研究

On Artifial dementia

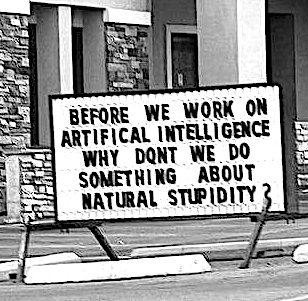

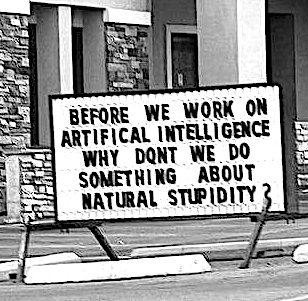

人工知能(機械そのものの)の素

直さに比べて人工知

能の研究者の頑迷や根性がねじ曲がった自己正当化の卑属さに閉口します。人工知

能の研究者が、どうして人工痴呆(AD)の研究をどうして始めないのか

不思

議な感じがします。逆遡上技術(RE)で豊富な実験資料手に入るはずなのに。チューリング・テストにならって、被験者が「この箱

に中に入っているやつは、バカ=痴呆か、『機械みたいなバカな奴だ』」と言った瞬間に、研究者や実験者はつかさず「そのアホさ加減とはどのような性格や行

動のことを言うのでしょう?」と問いかけるべきである。人工知能とならんで、果たして人工痴呆が作れるのか? 人工知能が「だんだん賢くなる」のであれ

ば、人工知能は「だんだんバカ」になる。痴呆症になることができるであろうか。すなわち人工痴呆は、人工知能研究と、人工知能の定義をめぐる問題のなか

で、重要な思考実験の位置を占めているのである。

私が考える、人工痴呆(AD)の研究の難しさは、人 工知能をつくりあげて、そこから痴呆にしなければならないという「偏見」がエンジニアにあるからではないか? 我々しろうとは、人工知能がアホな答えをし た時に(=チェスで打ち間違えて人間に負ける、ヒトラーまがいの反ユダヤメッセージを発するようになる、猿でもわかる臨床判断を間違う、などなど)、「そ こそこの痴呆力がついたなぁ」という発想をするけど、人工知能のエンジニアたちは、「まだまだ知力が足りないなあ」と反省するようだ。素人喜びと専門家の 悲しみは、相反する同じ軸に価値の数直線上にある。人間による人工ではない、天然痴呆の発見に、AIによる検証が役立つのではないかという主張 は次のような文言からでも明らかである。

"Researchers across the globe are developing computer programmes to spot the earliest signs of dementia. These teams are using huge amounts of data to identify changes to the physical structure of the brain in detailed scans. They are also looking for changes to the energy use and chemical make up of the brain that can’t be seen by the human eye." - How could artificial intelligence help people affected by dementia?︎

世界中の研究者が、認知症の初期兆候を発見するため

のコンピュータープログラムを開発している。これらのチームは、詳細なスキャンで脳の物理的構造の変化を特定するために、膨大な量のデータを使用してい

る。また、人間の目には見えない脳のエネルギー消費や化学物質の変化も調べている。

☆

| Kristina Šekrst

cautions that anthropomorphic terms such as "hallucination" can obscure

important ontological differences between artificial and human

cognition. While LLMs may produce human-like outputs, she argues that

it does not justify ascribing mental states or consciousness to them.

Instead, she advocates for an epistemological framework (such as

reliabilism) that recognizes the distinct nature of AI knowledge

production.[22] She suggests that apparent understanding in LLMs may be

a sophisticated form of AI hallucination. She also questions what would

happen if a LLM were trained without any mention of consciousness.[23] |

Kristina Šekrst

は、「幻覚」などの擬人化された用語は、人工知能と人間の認知の重要な存在論的相違を曖昧にするおそれがあると警告しています。LLM

は人間のような出力を生成するかもしれませんが、それを理由に、LLM(Large language model)

に精神状態や意識を帰属させることは正当化されない、と彼女は主張しています。代わりに、彼女はAIの知識生産の独自の性質を認める認識論的枠組み(例え

ば信頼性主義)を提唱している。[22] 彼女は、LLMにおける apparent

understanding(表面的理解)は、AIの幻覚の高度な形態である可能性があると指摘している。また、意識に関する言及なしにLLMを訓練した

場合、何が起こるかについても疑問を投げかけている。[23] |

| 22. Šekrst, Kristina (2024),

"Chinese Chat Room: AI hallucinations, epistemology and cognition",

Studies in Logic, Grammar and Rhetoric, 69 (1): 365–381,

doi:10.2478/slgr-2024-0029 23. Šekrst, Kristina (2025), "Do Large Language Models Hallucinate Electric Fata Morganas?", Journal of Consciousness Studies |

22. Šekrst, Kristina (2024),

「中国のチャットルーム:AI の幻覚、認識論、および認知」, Studies in Logic, Grammar and Rhetoric,

69 (1): 365–381, doi:10.2478/slgr-2024-0029 23. Šekrst, Kristina (2025), 「大規模言語モデルは電気の蜃気楼を幻覚するのだろうか?」, Journal of Consciousness Studies |

| https://en.wikipedia.org/wiki/Artificial_consciousness |

「コウモリになるとはどういうこと

か」

は、アメリカの哲学者トーマス・ネーゲルによる論文で、1974年10月に『The Philosophical

Review』に発表され、その後『Mortal

Questions』(1979年)に収録された。この論文では、「人間の概念の及ばない事実」に起因する心身問題の解決不可能性、客観性と還元主義の限

界、主観的経験の「現象学的特徴」、人間の想像力の限界、特定の意識的なものであることの意味など、意識がもたらすいくつかの困難が提示されている。ダニエル・デネットは、コウモリ(→ここでは痴呆症の人間を想起されたし)の意識はアクセスで

きないというナーゲルの主張を否定し、コウモリ(=痴呆症人)の意識の「興味深い、あるいは理論的に重要な」特徴であ

れば、第三者による観察が可能であると主張している。

例えば、コウモリが数メートル以上離れた物体を検知できないのは、エコロケーションの範囲が限られているからである。デネットは、その経験に類似した側面

があれば、さらなる科学的実験によって得ることができると考えている。彼はまた、ネーゲルの議論と疑問は新しいものではなく、1950年にB.A.ファレ

ルが『マインド』誌の論文「経験」において述べていたものであると指摘 している(→コウモリに

なるとはどういうことか?)。

リンク

文献

その他の情報

Copyleft, CC, Mitzub'ixi Quq Chi'j, 1996-2099

++

Copyleft, CC, Mitzub'ixi Quq Chi'j, 1996-2099

☆

☆

☆